자연어 처리를 위한 트랜스포머 모델 구현 🤖🔧

안녕하세요, 여러분! 오늘은 자연어 처리(NLP) 분야에서 혁명적인 변화를 가져온 트랜스포머 모델에 대해 깊이 있게 알아보고, 이를 직접 구현해보는 여정을 떠나보려고 합니다. 이 글은 프로그램 개발 카테고리의 응용 프로그래밍에 속하는 내용으로, 실용적이고 전문적인 지식을 제공하면서도 현재의 AI 트렌드를 반영하고 있습니다.

트랜스포머 모델은 2017년에 소개된 이후, GPT (Generative Pre-trained Transformer)와 BERT (Bidirectional Encoder Representations from Transformers)와 같은 강력한 언어 모델의 기반이 되었습니다. 이 모델들은 텍스트 생성, 기계 번역, 감성 분석 등 다양한 NLP 태스크에서 놀라운 성능을 보여주고 있죠. 재능넷과 같은 플랫폼에서도 이러한 AI 기술을 활용하여 사용자 경험을 개선하고 있을 정도로, 트랜스포머는 이제 현대 AI의 핵심 기술이 되었습니다.

그럼 이제 트랜스포머 모델의 구조부터 시작해서, 실제 구현 방법까지 단계별로 자세히 알아보도록 하겠습니다. 준비되셨나요? 그럼 시작해볼까요! 🚀

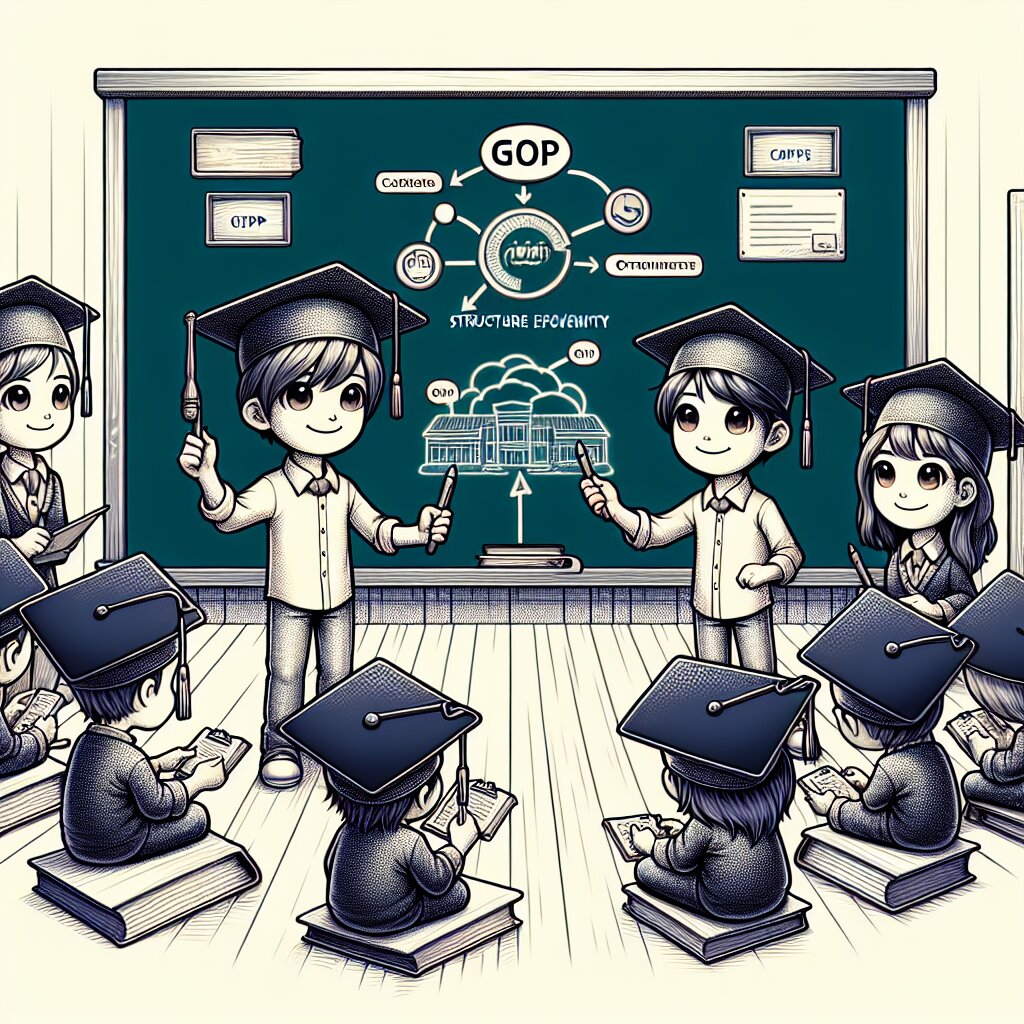

1. 트랜스포머 모델의 기본 구조 이해하기 🏗️

트랜스포머 모델은 인코더와 디코더로 구성된 seq2seq (sequence-to-sequence) 구조를 가지고 있습니다. 하지만 기존의 RNN (Recurrent Neural Network) 기반 모델들과는 달리, 트랜스포머는 순환 구조를 사용하지 않고 전적으로 어텐션 메커니즘에 의존합니다.

트랜스포머의 주요 구성 요소는 다음과 같습니다:

- 📌 인코더 (Encoder): 입력 시퀀스를 처리하고 이해합니다.

- 📌 디코더 (Decoder): 인코더의 출력을 바탕으로 목표 시퀀스를 생성합니다.

- 📌 멀티-헤드 어텐션 (Multi-Head Attention): 입력 시퀀스의 다양한 부분에 집중할 수 있게 해줍니다.

- 📌 포지션-와이즈 피드포워드 네트워크 (Position-wise Feed-Forward Network): 각 위치의 표현을 독립적으로 처리합니다.

- 📌 레이어 정규화 (Layer Normalization): 각 서브레이어의 출력을 정규화합니다.

- 📌 포지셔널 인코딩 (Positional Encoding): 시퀀스 내 각 토큰의 위치 정보를 제공합니다.

이 구조를 시각화하면 다음과 같습니다:

이 구조는 매우 효과적이며, 병렬 처리가 가능해 학습 속도도 빠릅니다. 또한, 장거리 의존성(long-range dependencies)을 잘 포착할 수 있어 복잡한 언어 이해 태스크에 특히 유용합니다.

다음 섹션에서는 이 구조의 각 요소를 더 자세히 살펴보고, 실제 구현 방법에 대해 알아보겠습니다. 트랜스포머 모델의 매력에 빠져보실 준비 되셨나요? 😊

2. 트랜스포머 모델의 핵심 요소: 어텐션 메커니즘 🔍

트랜스포머 모델의 핵심은 바로 어텐션 메커니즘입니다. 어텐션은 입력 시퀀스의 각 부분에 대해 모델이 얼마나 '주의를 기울일지'를 결정하는 메커니즘입니다. 이를 통해 모델은 입력의 중요한 부분에 집중할 수 있게 되죠.

트랜스포머에서 사용되는 어텐션은 '스케일드 닷-프로덕트 어텐션(Scaled Dot-Product Attention)'이라고 불립니다. 이 메커니즘은 다음과 같은 수식으로 표현됩니다:

여기서 Q는 쿼리(Query), K는 키(Key), V는 값(Value)을 나타내며, dk는 키의 차원을 의미합니다. 이 수식을 단계별로 살펴보면:

- QKT 계산: 쿼리와 키의 내적을 계산합니다. 이는 각 쿼리와 키 사이의 유사도를 나타냅니다.

- 스케일링: 내적 결과를 √dk로 나눕니다. 이는 큰 차원에서 내적 값이 너무 커지는 것을 방지합니다.

- Softmax 적용: 스케일링된 결과에 softmax 함수를 적용하여 확률 분포로 변환합니다.

- 값과의 곱셈: 마지막으로 이 확률 분포와 값을 곱합니다.

이 과정을 시각화하면 다음과 같습니다:

트랜스포머는 이 어텐션 메커니즘을 여러 번 병렬로 적용하는 '멀티-헤드 어텐션'을 사용합니다. 이를 통해 모델은 입력의 다양한 측면에 동시에 주목할 수 있게 됩니다.

어텐션 메커니즘의 장점은 다음과 같습니다:

- 📊 병렬 처리: RNN과 달리 순차적 처리가 필요 없어 병렬화가 가능합니다.

- 🔗 장거리 의존성 포착: 시퀀스의 길이에 관계없이 모든 위치 간의 관계를 직접 모델링할 수 있습니다.

- 🧠 해석 가능성: 어텐션 가중치를 시각화하여 모델의 '사고 과정'을 이해할 수 있습니다.

이러한 어텐션 메커니즘은 트랜스포머 모델의 성능을 크게 향상시키는 핵심 요소입니다. 다음 섹션에서는 이 어텐션 메커니즘을 실제로 어떻게 구현하는지 살펴보겠습니다. 준비되셨나요? 코딩의 세계로 들어가볼까요? 💻

3. 트랜스포머 모델 구현하기: 코드로 배우는 NLP 🖥️

이제 우리는 트랜스포머 모델의 기본 구조와 핵심 요소인 어텐션 메커니즘에 대해 이해했습니다. 그렇다면 이를 실제로 어떻게 구현할 수 있을까요? 이 섹션에서는 PyTorch를 사용하여 트랜스포머 모델의 주요 컴포넌트들을 구현해보겠습니다.

먼저, 필요한 라이브러리를 임포트하고 기본적인 설정을 해봅시다:

import torch

import torch.nn as nn

import torch.nn.functional as F

import math

class Config:

def __init__(self):

self.d_model = 512

self.n_heads = 8

self.d_ff = 2048

self.n_layers = 6

self.dropout = 0.1

config = Config()

이제 트랜스포머의 핵심인 멀티-헤드 어텐션을 구현해보겠습니다:

class MultiHeadAttention(nn.Module):

def __init__(self, config):

super().__init__()

self.d_model = config.d_model

self.n_heads = config.n_heads

self.d_k = self.d_model // self.n_heads

self.W_q = nn.Linear(self.d_model, self.d_model)

self.W_k = nn.Linear(self.d_model, self.d_model)

self.W_v = nn.Linear(self.d_model, self.d_model)

self.W_o = nn.Linear(self.d_model, self.d_model)

def scaled_dot_product_attention(self, Q, K, V, mask=None):

attn_scores = torch.matmul(Q, K.transpose(-2, -1)) / math.sqrt(self.d_k)

if mask is not None:

attn_scores = attn_scores.masked_fill(mask == 0, -1e9)

attn_probs = F.softmax(attn_scores, dim=-1)

output = torch.matmul(attn_probs, V)

return output

def split_heads(self, x):

batch_size, seq_length, d_model = x.size()

return x.view(batch_size, seq_length, self.n_heads, self.d_k).transpose(1, 2)

def combine_heads(self, x):

batch_size, _, seq_length, d_k = x.size()

return x.transpose(1, 2).contiguous().view(batch_size, seq_length, self.d_model)

def forward(self, Q, K, V, mask=None):

Q = self.split_heads(self.W_q(Q))

K = self.split_heads(self.W_k(K))

V = self.split_heads(self.W_v(V))

attn_output = self.scaled_dot_product_attention(Q, K, V, mask)

output = self.W_o(self.combine_heads(attn_output))

return output

위 코드에서 우리는 다음과 같은 주요 단계를 구현했습니다:

- 입력 변환: Q, K, V를 생성하기 위해 입력을 선형 변환합니다.

- 헤드 분할: 변환된 입력을 여러 개의 '헤드'로 분할합니다.

- 스케일드 닷-프로덕트 어텐션: 각 헤드에 대해 어텐션을 계산합니다.

- 헤드 결합: 각 헤드의 출력을 다시 하나로 결합합니다.

- 최종 변환: 결합된 출력을 다시 한 번 선형 변환합니다.

다음으로, 포지션-와이즈 피드포워드 네트워크를 구현해보겠습니다:

class PositionWiseFeedForward(nn.Module):

def __init__(self, config):

super().__init__()

self.fc1 = nn.Linear(config.d_model, config.d_ff)

self.fc2 = nn.Linear(config.d_ff, config.d_model)

self.dropout = nn.Dropout(config.dropout)

def forward(self, x):

return self.fc2(self.dropout(F.relu(self.fc1(x))))

이제 인코더 레이어를 구현해봅시다:

class EncoderLayer(nn.Module):

def __init__(self, config):

super().__init__()

self.mha = MultiHeadAttention(config)

self.ff = PositionWiseFeedForward(config)

self.norm1 = nn.LayerNorm(config.d_model)

self.norm2 = nn.LayerNorm(config.d_model)

self.dropout = nn.Dropout(config.dropout)

def forward(self, x, mask):

attn_output = self.mha(x, x, x, mask)

x = self.norm1(x + self.dropout(attn_output))

ff_output = self.ff(x)

x = self.norm2(x + self.dropout(ff_output))

return x

마지막으로, 전체 인코더를 구현합니다:

class Encoder(nn.Module):

def __init__(self, config):

super().__init__()

self.layers = nn.ModuleList([EncoderLayer(config) for _ in range(config.n_layers)])

def forward(self, x, mask):

for layer in self.layers:

x = layer(x, mask)

return x

이렇게 해서 우리는 트랜스포머의 인코더 부분을 구현했습니다! 🎉 이 코드는 실제 NLP 태스크에 사용될 수 있는 기본적인 틀을 제공합니다. 물론, 실제 사용을 위해서는 임베딩 레이어, 포지셔널 인코딩, 디코더 부분 등을 추가로 구현해야 합니다.

이 구현을 통해 우리는 트랜스포머 모델의 내부 동작을 더 깊이 이해할 수 있게 되었습니다. 재능넷과 같은 플랫폼에서도 이와 유사한 AI 기술을 활용하여 사용자 경험을 개선하고 있을 것입니다. 예를 들어, 사용자의 검색 쿼리를 더 잘 이해하거나, 개인화된 추천 시스템을 구축하는 데 이러한 기술이 사용될 수 있죠.

다음 섹션에서는 이 모델을 실제 태스크에 적용하는 방법과 성능을 최적화하는 팁에 대해 알아보겠습니다. 계속해서 흥미진진한 NLP의 세계를 탐험해볼까요? 💡

4. 트랜스포머 모델 최적화와 실제 적용 🚀

트랜스포머 모델을 구현했다고 해서 끝난 것이 아닙니다. 실제로 이 모델을 NLP 태스크에 적용하고 최적의 성능을 얻기 위해서는 여러 가지 최적화 기법과 실용적인 팁들이 필요합니다. 이 섹션에서는 트랜스포머 모델을 실제 상황에서 어떻게 활용하고 최적화할 수 있는지 알아보겠습니다.

4.1 데이터 전처리와 토큰화 🧹

트랜스포머 모델을 훈련시키기 전에 가장 먼저 해야 할 일은 데이터를 적절히 전처리하고 토큰화하는 것입니다. 이 과정은 모델의 성능에 큰 영향을 미칩니다.

- 텍스트 정제: HTML 태그 제거, 특수 문자 처리, 대소문자 통일 등

- 토큰화: 단어, 서브워드(subword), 또는 문자 단위로 텍스트를 토큰화

- 숫자 인코딩: 토큰을 숫자로 변환

- 패딩: 시퀀스의 길이를 동일하게 맞추기

예를 들어, 서브워드 토큰화를 위해 SentencePiece나 BPE(Byte Pair Encoding)를 사용할 수 있습니다:

from tokenizers import Tokenizer

from tokenizers.models import BPE

from tokenizers.trainers import BpeTrainer

tokenizer = Tokenizer(BPE(unk_token="[UNK]"))

trainer = BpeTrainer(special_tokens=["[UNK]", "[CLS]", "[SEP]", "[PAD]", "[MASK]"])

files = [...] # 훈련 데이터 파일 리스트

tokenizer.train(files, trainer)

# 토큰화 예시

encoded = tokenizer.encode("Hello, how are you?")

print(encoded.tokens)

4.2 학습 최적화 기법 🔧

트랜스포머 모델은 크고 복잡하기 때문에, 효과적인 학습을 위해 다양한 최적화 기법이 필요합니다.

- 학습률 스케줄링: 워밍업(Warmup)과 함께 학습률을 조절

- Gradient Clipping: 그래디언트 폭발 문제 방지

- Label Smoothing: 과적합 방지와 일반화 성능 향상

- Mixed Precision Training: 학습 속도 향상과 메모리 사용량 감소

이러한 기법들을 적용한 학습 루프의 예시를 살펴보겠습니다:

from torch.optim import Adam

from torch.optim.lr_scheduler import LambdaLR

optimizer = Adam(model.parameters(), lr=0.0001, betas=(0.9, 0.98), eps=1e-9)

def lr_lambda(step):

warmup_steps = 4000

return min(step ** (-0.5), step * warmup_steps ** (-1.5))

scheduler = LambdaLR(optimizer, lr_lambda)

for epoch in range(num_epochs):

for batch in dataloader:

optimizer.zero_grad()

loss = model(batch)

loss.backward()

torch.nn.utils.clip_grad_norm_(model.parameters(), max_norm=1.0)

optimizer.step()

scheduler.step()

print(f"Epoch {epoch+1}/{num_epochs}, Loss: {loss.item()}")

4.3 성능 평 가 평가와 모니터링 📊

모델의 성능을 지속적으로 평가하고 모니터링하는 것은 매우 중요합니다. 이를 통해 모델의 개선 여부를 확인하고 과적합 문제를 조기에 발견할 수 있습니다.

- 검증 세트 사용: 훈련 중 주기적으로 검증 세트에 대한 성능 평가

- 다양한 메트릭 활용: BLEU, ROUGE, METEOR 등 태스크에 적합한 평가 지표 사용

- Early Stopping: 검증 성능이 더 이상 개선되지 않을 때 학습 중단

- 텐서보드(TensorBoard) 활용: 학습 과정을 시각화하여 모니터링

다음은 검증 성능을 평가하고 Early Stopping을 구현하는 예시 코드입니다:

from torchtext.data.metrics import bleu_score

def evaluate(model, val_dataloader):

model.eval()

total_loss = 0

bleu_scores = []

with torch.no_grad():

for batch in val_dataloader:

loss = model(batch)

total_loss += loss.item()

# BLEU 점수 계산 (예시)

predictions = model.generate(batch['input_ids'])

references = [[tokenizer.decode(ref) for ref in batch['labels']]]

candidates = [tokenizer.decode(pred) for pred in predictions]

bleu_scores.append(bleu_score(candidates, references))

avg_loss = total_loss / len(val_dataloader)

avg_bleu = sum(bleu_scores) / len(bleu_scores)

return avg_loss, avg_bleu

# Early Stopping 구현

best_val_loss = float('inf')

patience = 5

counter = 0

for epoch in range(num_epochs):

train_loss = train(model, train_dataloader, optimizer, scheduler)

val_loss, val_bleu = evaluate(model, val_dataloader)

print(f"Epoch {epoch+1}/{num_epochs}, Train Loss: {train_loss:.4f}, Val Loss: {val_loss:.4f}, Val BLEU: {val_bleu:.4f}")

if val_loss < best_val_loss:

best_val_loss = val_loss

counter = 0

torch.save(model.state_dict(), 'best_model.pth')

else:

counter += 1

if counter >= patience:

print("Early stopping")

break

4.4 실제 적용 사례 🌟

트랜스포머 모델은 다양한 NLP 태스크에 적용될 수 있습니다. 여기 몇 가지 실제 적용 사례를 살펴보겠습니다:

- 기계 번역: 한 언어에서 다른 언어로 텍스트를 번역

- 텍스트 요약: 긴 문서를 짧게 요약

- 감성 분석: 텍스트의 감정 상태 분석

- 질의응답 시스템: 주어진 질문에 대한 답변 생성

- 챗봇: 사용자와의 대화형 인터페이스 구현

예를 들어, 재능넷과 같은 플랫폼에서 트랜스포머 모델을 활용하여 다음과 같은 기능을 구현할 수 있습니다:

- 사용자 리뷰 감성 분석을 통한 서비스 품질 모니터링

- 자동 응답 시스템을 통한 고객 문의 처리

- 프리랜서 프로필 요약 생성

- 다국어 지원을 위한 자동 번역 서비스

이러한 적용 사례에서 트랜스포머 모델의 성능을 최대화하기 위해서는 앞서 언급한 최적화 기법들을 적절히 활용하고, 도메인 특화 데이터로 모델을 파인튜닝하는 것이 중요합니다.

4.5 향후 발전 방향 🔮

트랜스포머 모델은 계속해서 발전하고 있습니다. 향후 주목할 만한 발전 방향은 다음과 같습니다:

- 더 큰 모델: GPT-3, PaLM과 같은 대규모 언어 모델의 등장

- 효율성 개선: Reformer, Performer 등 계산 효율성을 높인 변형 모델

- 다중 모달 학습: 텍스트뿐만 아니라 이미지, 음성 등을 함께 처리하는 모델

- 윤리적 AI: 편향성 감소, 공정성 향상을 위한 연구

이러한 발전은 NLP 기술의 활용 범위를 더욱 넓히고, 더 정확하고 효율적인 언어 처리 시스템의 개발을 가능하게 할 것입니다.

트랜스포머 모델의 구현과 최적화, 그리고 실제 적용에 대해 살펴보았습니다. 이 강력한 모델은 NLP 분야에 혁명을 일으켰으며, 앞으로도 계속해서 발전할 것입니다. 여러분도 이 흥미진진한 기술의 발전에 동참해보시는 건 어떨까요? 🚀

5. 결론: NLP의 미래와 트랜스포머 🌈

지금까지 우리는 트랜스포머 모델의 구조, 구현 방법, 최적화 기법, 그리고 실제 적용 사례에 대해 깊이 있게 살펴보았습니다. 이제 우리는 이 혁신적인 모델이 NLP 분야와 AI 기술 전반에 미치는 영향과 앞으로의 전망에 대해 정리해보겠습니다.

5.1 트랜스포머의 혁신성 🎯

트랜스포머 모델은 다음과 같은 이유로 NLP 분야에 혁명을 일으켰습니다:

- 병렬 처리: RNN의 순차적 처리 한계를 극복하여 학습 속도를 크게 향상

- 장거리 의존성 포착: 어텐션 메커니즘을 통해 긴 시퀀스에서도 중요한 정보를 효과적으로 포착

- 유연성: 다양한 NLP 태스크에 적용 가능한 범용성

- 확장성: 대규모 데이터셋과 모델 크기에 대한 뛰어난 확장성

5.2 NLP의 현재와 미래 🔭

트랜스포머의 등장으로 NLP 기술은 비약적인 발전을 이루었고, 이는 다양한 분야에 큰 영향을 미치고 있습니다:

- 비즈니스: 고객 서비스 개선, 시장 분석, 자동화된 보고서 생성

- 의료: 의료 기록 분석, 질병 진단 보조, 의학 연구 지원

- 교육: 개인화된 학습 경험, 자동 채점, 언어 학습 지원

- 미디어: 콘텐츠 추천, 자동 자막 생성, 가짜 뉴스 탐지

- 법률: 법률 문서 분석, 계약서 검토, 판례 검색

앞으로 NLP 기술은 더욱 발전하여 인간의 언어 이해와 생성 능력에 근접하거나 때로는 뛰어넘는 수준에 도달할 것으로 예상됩니다.

5.3 앞으로의 과제와 기회 🎢

트랜스포머 모델과 NLP 기술의 발전은 많은 기회를 제공하지만, 동시에 해결해야 할 과제도 있습니다:

- 계산 자원: 대규모 모델 학습에 필요한 막대한 컴퓨팅 파워와 에너지 소비 문제

- 데이터 품질: 편향되지 않은 고품질의 대규모 데이터셋 확보

- 윤리적 문제: AI의 편향성, 프라이버시 침해, 악용 가능성 등에 대한 대응

- 해석 가능성: 복잡한 모델의 의사결정 과정을 이해하고 설명하는 능력 향상

- 다국어 및 저자원 언어 지원: 영어 외 다양한 언어에 대한 성능 개선

이러한 과제들은 동시에 NLP 연구자와 개발자들에게 새로운 기회가 될 수 있습니다.

5.4 마무리 🌟

트랜스포머 모델은 NLP의 현재를 정의하고 미래를 형성하고 있습니다. 이 강력한 도구를 이해하고 활용하는 것은 AI 시대를 살아가는 우리에게 큰 경쟁력이 될 것입니다.

재능넷과 같은 플랫폼에서도 이러한 최신 NLP 기술을 적극적으로 도입하여 사용자 경험을 개선하고 새로운 가치를 창출할 수 있을 것입니다. 예를 들어, 더 정확한 프리랜서 매칭, 지능형 프로젝트 관리 도구, 다국어 소통 지원 등 다양한 혁신을 이룰 수 있겠죠.

우리는 이제 AI와 NLP 기술이 만들어갈 미래의 문턱에 서 있습니다. 이 흥미진진한 여정에 여러분도 함께 하시길 바랍니다. 끊임없이 학습하고, 실험하고, 도전하세요. 그리고 이 놀라운 기술을 통해 세상을 더 나은 곳으로 만드는 데 기여해보세요.

트랜스포머와 함께하는 NLP의 미래, 정말 기대되지 않나요? 여러분의 next big thing이 바로 여기에 있을지도 모릅니다! 🚀✨