Apache Hadoop: 대규모 분산 데이터 처리 시스템 구축 🐘💻

안녕, 친구들! 오늘은 정말 흥미진진한 주제로 찾아왔어. 바로 Apache Hadoop이라는 녀석인데, 이 친구가 어떻게 대규모 분산 데이터 처리 시스템을 구축하는지 함께 알아볼 거야. 😎

우리가 살고 있는 이 디지털 시대에는 엄청난 양의 데이터가 매일매일 쏟아지고 있어. 그런데 이 어마어마한 데이터를 어떻게 처리하고 분석할 수 있을까? 🤔 바로 여기서 Hadoop이 등장하는 거지! Hadoop은 마치 슈퍼히어로처럼 거대한 데이터를 손쉽게 다룰 수 있게 해주는 강력한 도구야.

자, 이제부터 Hadoop의 세계로 함께 떠나볼까? 준비됐니? 그럼 출발! 🚀

1. Hadoop이 뭐길래? 🧐

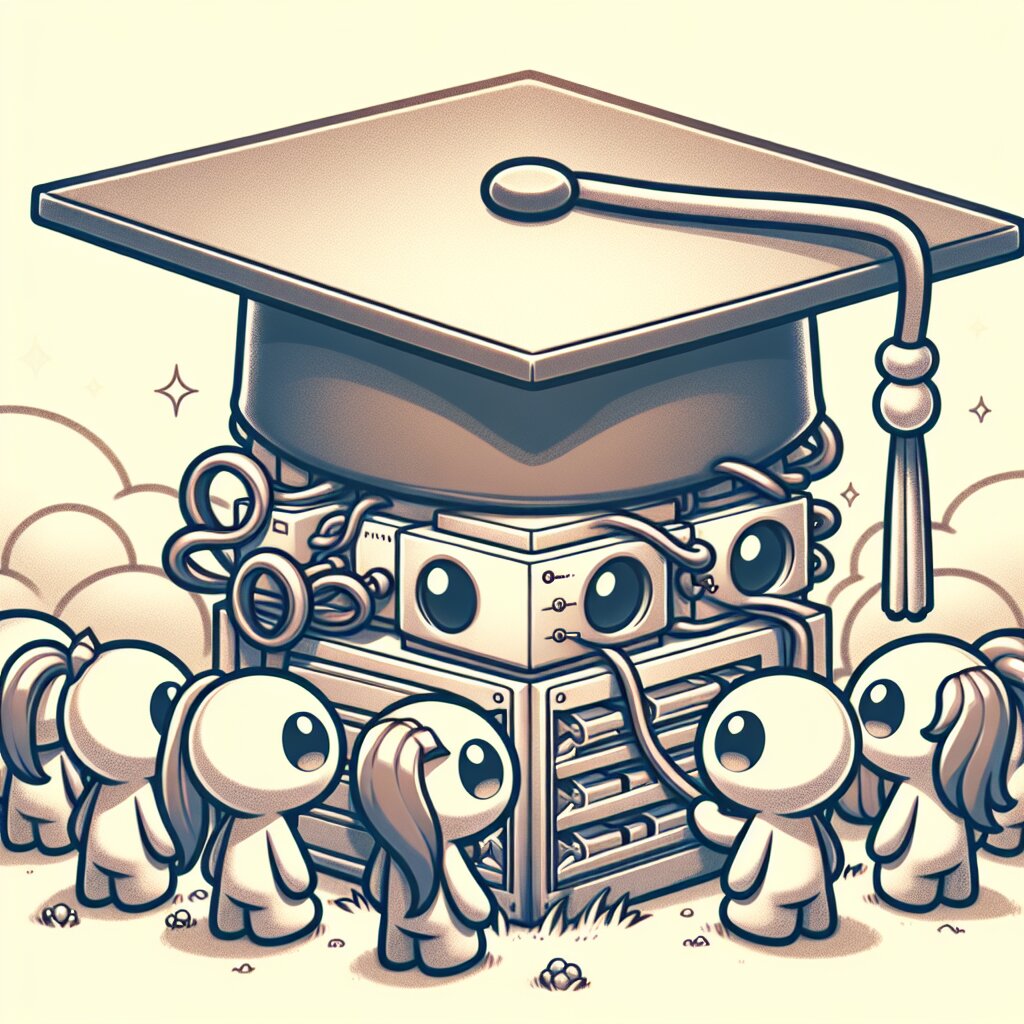

Hadoop, 이름부터 좀 특이하지? 실은 이 이름, 개발자의 아들이 가지고 놀던 노란 코끼리 인형 이름에서 따왔대. 귀엽지 않니? 😄

그런데 이 귀여운 이름의 Hadoop이 하는 일은 정말 대단해. Hadoop은 대용량 데이터를 분산 처리할 수 있는 오픈소스 프레임워크야. 쉽게 말해, 엄청나게 큰 데이터를 여러 대의 컴퓨터가 나눠서 처리할 수 있게 해주는 도구라고 볼 수 있지.

🌟 Hadoop의 핵심 특징:

- 대용량 데이터 처리 가능

- 분산 컴퓨팅 지원

- 높은 확장성

- 비용 효율적

- 오픈소스 (누구나 무료로 사용 가능!)

Hadoop은 마치 우리가 재능넷(https://www.jaenung.net)에서 다양한 재능을 공유하고 거래하는 것처럼, 여러 컴퓨터의 '재능'을 모아 큰 일을 해내는 거야. 재능넷이 다양한 분야의 전문가들을 연결해주듯, Hadoop은 여러 컴퓨터를 연결해 거대한 데이터를 처리하는 거지. 멋지지 않니? 😎

위의 그림을 보면, Hadoop이 어떻게 여러 데이터를 한 번에 처리하는지 이해가 될 거야. 마치 여러 명의 친구들이 함께 큰 퍼즐을 맞추는 것처럼, Hadoop은 여러 컴퓨터가 협력해서 큰 데이터를 처리하게 해주는 거지.

자, 이제 Hadoop이 뭔지 대충 감이 왔지? 그럼 이제 Hadoop의 핵심 구성 요소들을 자세히 살펴볼 차례야. 준비됐니? 다음 섹션으로 고고! 🏃♂️💨

2. Hadoop의 핵심 구성 요소 🧩

Hadoop은 크게 두 가지 핵심 구성 요소로 이루어져 있어. 바로 HDFS(Hadoop Distributed File System)와 MapReduce야. 이 두 녀석이 어떤 일을 하는지 자세히 알아보자!

2.1 HDFS (Hadoop Distributed File System) 📁

HDFS는 말 그대로 '분산 파일 시스템'이야. 엄청나게 큰 파일을 여러 대의 컴퓨터에 나눠서 저장하는 시스템이지. 마치 우리가 큰 책을 여러 권으로 나눠서 책장에 꽂아두는 것처럼 말이야.

🌟 HDFS의 주요 특징:

- 대용량 파일 저장에 최적화

- 데이터를 여러 노드에 분산 저장

- 높은 내구성과 가용성

- 스트리밍 방식의 데이터 접근

- 한 번 쓰고 여러 번 읽는 패턴에 적합

HDFS는 크게 두 가지 종류의 노드로 구성돼 있어:

- NameNode: 파일 시스템의 메타데이터를 관리하는 마스터 서버야. 파일이 어디에 저장되어 있는지, 어떤 상태인지 등을 관리해.

- DataNode: 실제 데이터를 저장하는 노드들이야. 여러 대의 DataNode가 존재하고, 각각이 데이터의 일부를 저장하고 있지.

위 그림을 보면, NameNode가 중앙에서 전체를 관리하고, 여러 DataNode들이 실제 데이터를 저장하고 있는 모습을 볼 수 있어. 마치 도서관에서 사서(NameNode)가 책의 위치를 알려주고, 실제 책(데이터)은 여러 책장(DataNode)에 나눠 저장되어 있는 것과 비슷하지?

2.2 MapReduce 🗺️➡️🔢

MapReduce는 Hadoop의 데이터 처리 엔진이야. 이 녀석은 대용량 데이터를 병렬로 처리할 수 있게 해주는 프로그래밍 모델이지. 이름에서 알 수 있듯이, Map과 Reduce 두 단계로 구성되어 있어.

🌟 MapReduce의 주요 특징:

- 대규모 데이터 세트를 병렬로 처리

- 분산 컴퓨팅 환경에 최적화

- 높은 내결함성

- 복잡한 데이터 처리 작업을 단순화

- 확장성이 뛰어남

MapReduce의 처리 과정을 간단히 설명하면 이렇게 돼:

- Map 단계: 입력 데이터를 키-값 쌍으로 변환하고 처리해.

- Shuffle & Sort 단계: Map의 출력을 정렬하고 그룹화해.

- Reduce 단계: 그룹화된 데이터를 집계하거나 요약해.

이 그림을 보면 MapReduce의 전체 과정을 한눈에 볼 수 있어. 입력 데이터가 Map을 거쳐 처리되고, Shuffle & Sort 과정을 통해 정리된 후, Reduce 단계에서 최종 결과물로 만들어지는 거지.

예를 들어, 우리가 재능넷에서 가장 인기 있는 재능을 찾고 싶다고 해보자. Map 단계에서는 각 거래 기록을 재능 별로 분류하고, Reduce 단계에서는 각 재능의 거래 횟수를 집계해서 가장 많이 거래된 재능을 찾을 수 있을 거야. 이렇게 MapReduce를 사용하면 엄청난 양의 데이터도 효율적으로 처리할 수 있지!

자, 이제 Hadoop의 두 가지 핵심 구성 요소에 대해 알아봤어. HDFS가 데이터를 저장하고 관리한다면, MapReduce는 그 데이터를 처리하는 역할을 하는 거지. 이 두 녀석이 함께 일하면서 Hadoop은 대규모 데이터를 효과적으로 다룰 수 있는 거야.

다음 섹션에서는 Hadoop을 실제로 어떻게 설치하고 구성하는지 알아볼 거야. 준비됐니? 그럼 고고! 🚀

3. Hadoop 설치 및 구성하기 🛠️

자, 이제 Hadoop을 직접 설치하고 구성해볼 차례야! 마치 레고 블록을 조립하듯이, 하나하나 차근차근 해보자. 걱정 마, 어렵지 않을 거야! 😉

3.1 사전 준비사항 📋

Hadoop을 설치하기 전에 몇 가지 준비해야 할 것들이 있어:

- Java 설치 (Hadoop은 Java로 작성되었기 때문에 필수!)

- SSH 설정 (Hadoop 클러스터의 노드들 간 통신을 위해 필요)

- 충분한 저장 공간

- 리눅스 운영 체제 (Ubuntu나 CentOS를 추천해)

3.2 Hadoop 다운로드 및 설치 💾

자, 이제 본격적으로 Hadoop을 설치해보자!

- 먼저, Apache Hadoop 공식 웹사이트에서 최신 버전의 Hadoop을 다운로드해.

- 다운로드한 파일을 적당한 디렉토리에 압축 해제해. 보통 /usr/local/ 디렉토리를 많이 사용해.

터미널에서 다음과 같은 명령어를 입력하면 돼:

wget https://downloads.apache.org/hadoop/common/hadoop-3.3.4/hadoop-3.3.4.tar.gz

tar -xzvf hadoop-3.3.4.tar.gz -C /usr/local/

mv /usr/local/hadoop-3.3.4 /usr/local/hadoop이렇게 하면 Hadoop이 /usr/local/hadoop 디렉토리에 설치될 거야.

3.3 환경 변수 설정 🌳

Hadoop이 제대로 동작하려면 몇 가지 환경 변수를 설정해줘야 해. ~/.bashrc 파일을 열어서 다음 내용을 추가해줘:

export HADOOP_HOME=/usr/local/hadoop

export PATH=$PATH:$HADOOP_HOME/bin

export PATH=$PATH:$HADOOP_HOME/sbin

export HADOOP_MAPRED_HOME=$HADOOP_HOME

export HADOOP_COMMON_HOME=$HADOOP_HOME

export HADOOP_HDFS_HOME=$HADOOP_HOME

export YARN_HOME=$HADOOP_HOME이렇게 하면 시스템이 Hadoop 관련 명령어를 어디서 찾아야 할지 알 수 있게 돼.

3.4 Hadoop 설정 파일 수정 ⚙️

이제 Hadoop의 주요 설정 파일들을 수정해야 해. 주요 설정 파일들은 $HADOOP_HOME/etc/hadoop/ 디렉토리에 있어.

- core-site.xml: HDFS의 기본 설정을 담당해.

- hdfs-site.xml: HDFS의 복제 팩터, 블록 크기 등을 설정해.

- mapred-site.xml: MapReduce 관련 설정을 담당해.

- yarn-site.xml: YARN(Yet Another Resource Negotiator) 관련 설정을 담당해.

각 파일의 기본 설정을 살펴보자:

core-site.xml:

<configuration>

<property>

<name>fs.defaultFS</name>

<value>hdfs://localhost:9000</value>

</property>

</configuration>hdfs-site.xml:

<configuration>

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

</configuration>mapred-site.xml:

<configuration>

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

</configuration>yarn-site.xml:

<configuration>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

</configuration>이 설정들은 기본적인 것들이야. 실제 운영 환경에서는 더 많은 설정을 조정해야 할 수도 있어.

3.5 HDFS 포맷 및 Hadoop 시작 🚀

모든 설정이 끝났다면, 이제 HDFS를 포맷하고 Hadoop을 시작할 차례야!

- HDFS 포맷:

hdfs namenode -format - Hadoop 시작:

start-dfs.sh start-yarn.sh

이렇게 하면 Hadoop이 시작되고, HDFS와 YARN이 실행될 거야.

3.6 Hadoop 동작 확인 🔍

Hadoop이 제대로 실행되고 있는지 확인하려면 다음 명령어를 사용해봐:

jps이 명령어를 실행하면 다음과 같은 프로세스들이 보여야 해:

- NameNode

- DataNode

- SecondaryNameNode

- ResourceManager

- NodeManager

또한, 웹 브라우저에서 다음 주소로 접속하면 Hadoop의 웹 인터페이스를 볼 수 있어:

- HDFS: http://localhost:9870

- YARN: http://localhost:8088

와우! 🎉 이제 너만의 Hadoop 클러스터가 동작하고 있어! 정말 대단해!

Hadoop 설치는 처음에는 좀 복잡해 보일 수 있지만, 한 번 해보면 그렇게 어렵지 않다는 걸 알 수 있을 거야. 마치 재능넷에서 새로운 재능을 배우는 것처럼, 처음에는 어려워 보여도 차근차근 따라하다 보면 어느새 마스터가 되어 있을 거야!

다음 섹션에서는 이렇게 설치한 Hadoop을 실제로 어떻게 사용하는지 알아볼 거야. 준비됐니? 그럼 고고! 🚀

4. Hadoop 사용하기: 실전 예제 🎮

자, 이제 우리의 Hadoop 클러스터가 준비됐어! 🎉 이제 이 강력한 도구를 어떻게 사용하는지 알아볼 차례야. 마치 새로운 게임을 시작하는 것처럼 흥미진진할 거야! 😄

4.1 HDFS 사용하기 📁

먼저 HDFS를 사용해보자. HDFS는 우리의 데이터를 저장하는 곳이야. 마치 거대한 창고같은 거지!

- 디렉토리 생성:

이 명령어로 HDFS에 새로운 디렉토리를 만들 수 있어.hdfs dfs -mkdir /user/hadoop-user - 파일 업로드:

이렇게 하면 로컬 파일을 HDFS로 업로드할 수 있어. li>hdfs dfs -put localfile.txt /user/hadoop-user/ - 파일 내용 확인:

이 명령어로 HDFS에 있는 파일의 내용을 볼 수 있어.hdfs dfs -cat /user/hadoop-user/localfile.txt - 파일 목록 확인:

디렉토리 안의 파일 목록을 볼 수 있지.hdfs dfs -ls /user/hadoop-user/

이렇게 HDFS를 사용하면 엄청난 양의 데이터도 쉽게 저장하고 관리할 수 있어. 마치 재능넷에서 다양한 재능들을 카테고리별로 정리하는 것처럼 말이야! 😉

4.2 MapReduce 작업 실행하기 🗺️➡️🔢

이제 MapReduce를 사용해서 실제로 데이터를 처리해보자. 간단한 예제로 워드 카운트(단어 세기) 프로그램을 실행해볼 거야.

- Java 코드 작성: 먼저 WordCount.java 파일을 만들어 다음 코드를 작성해.

import java.io.IOException;

import java.util.StringTokenizer;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.Mapper;

import org.apache.hadoop.mapreduce.Reducer;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

public class WordCount {

public static class TokenizerMapper

extends Mapper<object text intwritable>{

private final static IntWritable one = new IntWritable(1);

private Text word = new Text();

public void map(Object key, Text value, Context context

) throws IOException, InterruptedException {

StringTokenizer itr = new StringTokenizer(value.toString());

while (itr.hasMoreTokens()) {

word.set(itr.nextToken());

context.write(word, one);

}

}

}

public static class IntSumReducer

extends Reducer<text> {

private IntWritable result = new IntWritable();

public void reduce(Text key, Iterable<intwritable> values,

Context context

) throws IOException, InterruptedException {

int sum = 0;

for (IntWritable val : values) {

sum += val.get();

}

result.set(sum);

context.write(key, result);

}

}

public static void main(String[] args) throws Exception {

Configuration conf = new Configuration();

Job job = Job.getInstance(conf, "word count");

job.setJarByClass(WordCount.class);

job.setMapperClass(TokenizerMapper.class);

job.setCombinerClass(IntSumReducer.class);

job.setReducerClass(IntSumReducer.class);

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(IntWritable.class);

FileInputFormat.addInputPath(job, new Path(args[0]));

FileOutputFormat.setOutputPath(job, new Path(args[1]));

System.exit(job.waitForCompletion(true) ? 0 : 1);

}

}</intwritable></text></object>- 컴파일: 이 Java 코드를 컴파일해서 JAR 파일로 만들어야 해.

- 입력 파일 준비: HDFS에 입력 파일을 업로드해. 예를 들어, 재능넷의 모든 재능 설명을 모아놓은 텍스트 파일을 사용할 수 있겠지?

- MapReduce 작업 실행: 다음 명령어로 MapReduce 작업을 실행해봐.

hadoop jar WordCount.jar WordCount /user/hadoop-user/input /user/hadoop-user/output - 결과 확인: 작업이 완료되면 출력 디렉토리에서 결과를 확인할 수 있어.

hdfs dfs -cat /user/hadoop-user/output/*

이렇게 하면 입력 파일에 있는 각 단어의 출현 횟수를 세어서 결과를 보여줄 거야. 예를 들어, 재능넷의 재능 설명에서 가장 많이 사용된 단어가 무엇인지 알 수 있겠지? 이런 정보는 트렌드 분석이나 마케팅에 정말 유용할 거야! 😃

4.3 Hadoop 생태계의 다른 도구들 🌳

Hadoop은 그 자체로도 강력하지만, 다양한 관련 도구들과 함께 사용하면 더욱 강력해져. 몇 가지 중요한 도구들을 소개할게:

- Hive: SQL과 유사한 HiveQL을 사용해 데이터를 쿼리할 수 있어. 데이터 분석가들이 좋아하지!

- Pig: 대규모 데이터셋을 분석하기 위한 고수준 스크립팅 언어를 제공해.

- HBase: Hadoop 위에서 동작하는 NoSQL 데이터베이스야. 실시간 읽기/쓰기 작업에 적합해.

- Spark: 인메모리 처리를 지원하는 고속 데이터 처리 엔진이야. MapReduce보다 훨씬 빠르대!

이런 도구들을 활용하면 재능넷의 데이터를 더욱 다양하고 효율적으로 분석할 수 있을 거야. 예를 들어, Hive를 사용해 인기 있는 재능 카테고리를 쉽게 찾아낼 수 있고, HBase를 사용해 실시간으로 사용자 활동을 추적할 수 있지!

4.4 실전 시나리오: 재능넷 데이터 분석 📊

자, 이제 우리가 배운 것을 재능넷에 적용해볼까? 가상의 시나리오를 만들어볼게:

재능넷에서는 매일 엄청난 양의 로그 데이터가 생성돼. 이 데이터에는 사용자의 클릭, 검색, 구매 정보 등이 포함되어 있어. 이 데이터를 분석해서 유용한 인사이트를 얻고 싶어!

- 데이터 수집: 모든 로그 데이터를 HDFS에 저장해.

- 데이터 처리: MapReduce 작업을 사용해 로그 데이터를 처리해. 예를 들어, 시간대별 사이트 트래픽, 가장 많이 검색된 재능, 구매 전환율이 높은 재능 등을 계산할 수 있어.

- 데이터 분석: Hive를 사용해 처리된 데이터를 쿼리하고 분석해. SQL과 비슷한 문법을 사용하기 때문에 데이터 분석가들이 쉽게 사용할 수 있어.

- 실시간 모니터링: HBase를 사용해 실시간으로 사용자 활동을 추적하고, 이상 징후를 감지할 수 있어.

- 예측 모델링: Spark를 사용해 머신러닝 모델을 만들어 사용자의 행동을 예측하거나, 개인화된 재능 추천 시스템을 구축할 수 있어.

이렇게 Hadoop 생태계를 활용하면, 재능넷은 데이터 기반의 의사결정을 할 수 있게 되고, 사용자 경험을 크게 개선할 수 있을 거야. 예를 들어, 인기 있는 재능을 더 눈에 띄게 배치하거나, 사용자의 관심사에 맞는 재능을 추천할 수 있겠지? 😊

와우! 여기까지 왔다니 정말 대단해! 🎉 Hadoop의 기본부터 실제 활용 방법까지 배웠어. 이제 너도 빅데이터 전문가의 길에 한 발짝 다가섰다고 볼 수 있어. 앞으로 더 많은 것을 배우고 경험하면서, 데이터의 바다에서 귀중한 보물을 찾아내는 탐험가가 되길 바라! 화이팅! 💪😄