분산 작업 큐 시스템: Celery와 RabbitMQ 활용 🚀🐰

안녕하세요, 미래의 분산 시스템 마스터들! 오늘은 정말 흥미진진한 주제로 여러분을 찾아왔습니다. 바로 Celery와 RabbitMQ를 활용한 분산 작업 큐 시스템에 대해 알아볼 거예요. 마치 토끼가 당근을 나르듯, 우리의 작업들이 효율적으로 처리되는 과정을 함께 살펴보겠습니다! 🐰🥕

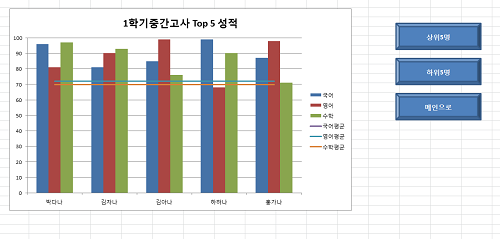

목차

- 1. 분산 작업 큐란 무엇인가? 🤔

- 2. Celery: 파이썬의 분산 작업 처리 영웅 🦸♂️

- 3. RabbitMQ: 메시지의 토끼 특급 배달부 🐰📨

- 4. Celery와 RabbitMQ의 환상의 콜라보 💑

- 5. 실전! Celery와 RabbitMQ 설정하기 🛠️

- 6. 작업 정의와 실행: 당신의 첫 분산 작업 🎉

- 7. 고급 기능: 작업 스케줄링과 모니터링 📊

- 8. 성능 최적화와 스케일링 전략 📈

- 9. 실제 사례 연구: 분산 시스템의 힘 💪

- 10. 마무리: 분산의 미래, 당신의 미래 🚀

자, 이제 우리의 분산 작업 큐 여행을 시작해볼까요? 안전벨트 꽉 매세요. 출발합니다! 🚗💨

1. 분산 작업 큐란 무엇인가? 🤔

여러분, 한 번 상상해보세요. 여러분이 인기 폭발 중인 온라인 쇼핑몰을 운영하고 있다고 말이죠. 블랙 프라이데이 특별 세일 기간에 갑자기 주문이 폭주합니다. 🛒💥 서버는 과부하로 끙끙대고, 고객들은 불만을 토로하기 시작합니다. 이런 상황에서 우리의 영웅, 분산 작업 큐 시스템이 등장합니다!

분산 작업 큐란? 간단히 말해, 작업들을 여러 워커(작업자)에게 분배하여 효율적으로 처리하는 시스템입니다. 마치 주방에서 여러 요리사가 각자의 역할을 맡아 요리를 만드는 것과 비슷하죠! 🍳👨🍳👩🍳

분산 작업 큐의 주요 구성 요소

- 작업 (Task): 처리해야 할 일 (예: 이메일 발송, 이미지 처리)

- 큐 (Queue): 작업들이 대기하는 줄

- 워커 (Worker): 실제로 작업을 처리하는 프로세스

- 브로커 (Broker): 작업을 큐에 넣고 워커에게 분배하는 중개자

이 시스템의 아름다움은 바로 확장성(Scalability)과 신뢰성(Reliability)에 있습니다. 부하가 증가하면? 간단히 워커를 추가하면 됩니다. 한 워커가 실패해도? 다른 워커가 그 작업을 대신 처리합니다. 완벽하지 않나요? 😎

분산 작업 큐의 장점

- 성능 향상: 여러 작업을 동시에 처리할 수 있어 전체 처리 속도가 빨라집니다. 🏎️💨

- 자원 효율성: 리소스를 효율적으로 사용하여 비용을 절감할 수 있습니다. 💰

- 안정성: 한 워커가 실패해도 시스템 전체가 멈추지 않습니다. 💪

- 유연성: 필요에 따라 쉽게 확장하거나 축소할 수 있습니다. 🔄

이러한 장점들 때문에 분산 작업 큐 시스템은 현대 웹 애플리케이션에서 필수적인 요소가 되었습니다. 특히 대규모 데이터 처리나 실시간 분석 등이 필요한 서비스에서 더욱 그 진가를 발휘하죠.

재능넷 활용 예시: 예를 들어, 재능넷(https://www.jaenung.net)에서 사용자들이 올린 포트폴리오 이미지를 자동으로 최적화하고 썸네일을 생성하는 작업을 분산 작업 큐로 처리할 수 있습니다. 이렇게 하면 사용자 경험을 해치지 않으면서도 효율적으로 대량의 이미지를 처리할 수 있겠죠! 🖼️✨

자, 이제 분산 작업 큐의 개념을 이해하셨나요? 그렇다면 이제 우리의 주인공들, Celery와 RabbitMQ를 만나볼 시간입니다! 다음 섹션에서 이 두 기술이 어떻게 분산 작업 큐를 구현하는지 자세히 알아보겠습니다. 준비되셨나요? Let's go! 🚀

2. Celery: 파이썬의 분산 작업 처리 영웅 🦸♂️

여러분, 이제 우리의 첫 번째 주인공 Celery를 소개할 시간입니다! Celery는 마치 슈퍼히어로처럼 파이썬 세계에서 분산 작업 처리의 문제를 해결해주는 강력한 도구입니다. 🦸♂️💪

Celery란? Celery는 파이썬으로 작성된 비동기 작업 큐/작업 스케줄러입니다. 분산 메시지 전달을 기반으로 동작하며, 실시간 처리와 작업 스케줄링을 모두 지원합니다.

Celery의 주요 특징

- 간편한 사용: 파이썬 코드로 쉽게 작업을 정의하고 실행할 수 있습니다. 🐍✨

- 유연성: 다양한 브로커(RabbitMQ, Redis 등)와 결과 백엔드를 지원합니다. 🔄

- 확장성: 수평적 확장이 용이하여 대규모 처리에 적합합니다. 📈

- 신뢰성: 작업 재시도, 타임아웃 등의 기능으로 안정적인 처리를 보장합니다. 🛡️

- 모니터링: Flower와 같은 도구를 통해 실시간 모니터링이 가능합니다. 📊

Celery의 작동 원리

Celery의 작동 원리를 이해하기 위해, 우리의 일상에서 흔히 볼 수 있는 카페를 예로 들어볼까요? ☕

- 고객 (Client): 작업을 요청하는 주체입니다. 카페에서 음료를 주문하는 손님과 같죠.

- 카운터 (Broker): 주문을 받고 바리스타에게 전달하는 중간자 역할을 합니다. Celery에서는 RabbitMQ나 Redis가 이 역할을 수행합니다.

- 바리스타 (Worker): 실제로 음료를 만드는 사람입니다. Celery 워커가 이에 해당하며, 할당된 작업을 처리합니다.

- 음료 (Result): 완성된 작업의 결과물입니다. Celery에서는 이를 결과 백엔드에 저장할 수 있습니다.

이 비유를 통해 Celery의 작동 방식을 쉽게 이해할 수 있겠죠? 😊

Celery 사용의 장점

비동기 처리 🚀

시간이 오래 걸리는 작업을 백그라운드에서 처리하여 사용자 경험을 향상시킵니다.

부하 분산 ⚖️

여러 워커에 작업을 분산하여 시스템의 전체적인 성능을 향상시킵니다.

스케줄링 🕒

주기적인 작업을 쉽게 예약하고 관리할 수 있습니다.

Celery 사용 예시

Celery를 사용하는 간단한 예제를 살펴볼까요? 이 예제에서는 시간이 오래 걸리는 작업을 비동기적으로 처리합니다.

# tasks.py

from celery import Celery

app = Celery('tasks', broker='pyamqp://guest@localhost//')

@app.task

def add(x, y):

# 복잡한 계산을 시뮬레이션하기 위해 잠시 대기

import time

time.sleep(5)

return x + y

# 사용 예시

from tasks import add

result = add.delay(4, 4)

print("작업이 백그라운드에서 실행 중입니다...")

print(f"결과: {result.get()}") # 이 줄에서 결과를 기다립니다

이 예제에서 add 함수는 Celery 작업으로 정의되었습니다. delay() 메서드를 사용하여 이 작업을 비동기적으로 실행할 수 있으며, get() 메서드로 결과를 받아올 수 있습니다.

재능넷 활용 팁: 재능넷(https://www.jaenung.net)에서 사용자가 대용량 포트폴리오 파일을 업로드할 때, Celery를 사용하여 파일 처리 작업을 백그라운드에서 수행할 수 있습니다. 이렇게 하면 사용자는 업로드 후 바로 다른 작업을 계속할 수 있어 사용자 경험이 크게 향상됩니다! 🚀📁

Celery의 고급 기능

Celery는 기본적인 작업 처리 외에도 다양한 고급 기능을 제공합니다:

- 작업 우선순위: 중요한 작업을 먼저 처리할 수 있습니다. 🏅

- 작업 재시도: 실패한 작업을 자동으로 재시도합니다. 🔄

- 작업 취소: 실행 중인 작업을 취소할 수 있습니다. ❌

- 작업 체이닝: 여러 작업을 연결하여 복잡한 워크플로우를 만들 수 있습니다. 🔗

- 주기적 작업: crontab과 유사한 방식으로 주기적인 작업을 예약할 수 있습니다. 🔁

이러한 기능들을 활용하면 더욱 강력하고 유연한 분산 시스템을 구축할 수 있습니다.

Celery의 미래

Celery는 계속해서 발전하고 있으며, 최신 버전에서는 다음과 같은 개선사항들이 포함되어 있습니다:

- 비동기 I/O 지원 강화

- 타입 힌팅 지원

- 보안 기능 강화

- 성능 최적화

이러한 발전은 Celery가 앞으로도 파이썬 생태계에서 중요한 위치를 차지할 것임을 보여줍니다.

주의사항: Celery의 강력함에 매료되어 모든 작업을 비동기로 처리하려는 유혹에 빠질 수 있습니다. 하지만 각 작업의 특성을 고려하여 적절히 사용하는 것이 중요합니다. 때로는 동기 처리가 더 효율적일 수 있다는 점을 명심하세요! 🤔💡

자, 이제 Celery에 대해 꽤 깊이 있게 알아보았습니다. Celery는 정말 강력한 도구지만, 혼자서는 제 기능을 다 발휘하기 어렵습니다. 여기서 우리의 두 번째 주인공, RabbitMQ가 등장합니다! 다음 섹션에서는 RabbitMQ에 대해 자세히 알아보고, 이 둘이 어떻게 환상의 팀워크를 이루는지 살펴보겠습니다. 계속해서 함께 가실 준비 되셨나요? Let's hop to it! 🐰💨

3. RabbitMQ: 메시지의 토끼 특급 배달부 🐰📨

자, 이제 우리의 두 번째 주인공 RabbitMQ를 소개할 시간입니다! RabbitMQ는 마치 빠른 토끼처럼 메시지를 신속하게 전달하는 메시지 브로커입니다. Celery의 든든한 파트너로서, 분산 시스템의 핵심 역할을 담당하죠. 🐰💨

RabbitMQ란? RabbitMQ는 AMQP(Advanced Message Queuing Protocol)를 구현한 오픈 소스 메시지 브로커 소프트웨어입니다. 다양한 메시징 프로토콜을 지원하며, 높은 신뢰성과 확장성을 자랑합니다.

RabbitMQ의 주요 특징

- 신뢰성: 메시지 전달을 보장하며, 시스템 장애 시에도 데이터 손실을 방지합니다. 🛡️

- 유연성: 다양한 메시징 패턴(발행/구독, 라우팅 등)을 지원합니다. 🔀

- 확장성: 클러스터링을 통해 대규모 처리가 가능합니다. 📈

- 관리 용이성: 웹 기반 관리 인터페이스를 제공하여 모니터링과 관리가 쉽습니다. 🖥️

- 다중 프로토콜 지원: AMQP, MQTT, STOMP 등 다양한 프로토콜을 지원합니다. 🌐

RabbitMQ의 작동 원리

RabbitMQ의 작동 원리를 이해하기 위해, 우리 주변에서 흔히 볼 수 있는 우체국 시스템을 예로 들어볼까요? 📮

- 발신자 (Producer): 메시지를 생성하고 보내는 주체입니다. 편지를 쓰는 사람과 같죠.

- 우체국 (Exchange): 메시지를 받아 적절한 큐로 라우팅하는 역할을 합니다. 우체국에서 편지를 분류하는 것과 비슷합니다.

- 우편함 (Queue): 메시지가 저장되는 버퍼입니다. 각 수신자의 우편함과 같은 역할을 합니다.

- 수신자 (Consumer): 큐에서 메시지를 가져가 처리하는 주체입니다. 우편함에서 편지를 꺼내 읽는 사람과 같습니다.

이 비유를 통해 RabbitMQ의 기본적인 작동 방식을 이해할 수 있습니다. 실제로는 이보다 더 복잡하고 다양한 라우팅 전략과 메시징 패턴을 지원하지만, 기본 개념은 이와 유사합니다. 😊

RabbitMQ 사용의 장점

비동기 통신 🔀

서비스 간 느슨한 결합을 가능하게 하여 시스템의 유연성을 높입니다.

부하 분산 ⚖️

메시지를 여러 소비자에게 분산하여 처리할 수 있어 시스템 부하를 줄입니다.

피크 처리 🏔️

트래픽 급증 시에도 메시지를 큐에 저장해 두었다가 순차적으로 처리할 수 있습니다.

RabbitMQ 사용 예시

Python의 pika 라이브러리를 사용하여 RabbitMQ와 상호작용하는 간단한 예제를 살펴볼까요?

# 메시지 발행 (Producer)

import pika

connection = pika.BlockingConnection(pika.ConnectionParameters('localhost'))

channel = connection.channel()

channel.queue_declare(queue='hello')

channel.basic_publish(exchange='',

routing_key='hello',

body='Hello World!')

print(" [x] Sent 'Hello World!'")

connection.close()

# 메시지 소비 (Consumer)

import pika

connection = pika.BlockingConnection(pika.ConnectionParameters('localhost'))

channel = connection.channel()

channel.queue_declare(queue='hello')

def callback(ch, method, properties, body):

print(f" [x] Received {body}")

channel.basic_consume(queue='hello',

auto_ack=True,

on_message_callback=callback)

print(' [*] Waiting for messages. To exit press CTRL+C')

channel.start_consuming()

이 예제에서는 'hello' 큐에 메시지를 발행하고, 다른 프로세스에서 이 메시지를 소비하는 간단한 구조를 보여줍니다.

재능넷 활용 팁: 재능넷(https://www.jaenung.net)에서 RabbitMQ를 활용하면, 예를 들어 사용자 알림 시스템을 구현할 수 있습니다. 새로운 프로젝트 제안이 올라왔을 때, 관심 있는 프리랜서들에게 실시간으로 알림을 보내는 기능을 RabbitMQ를 통해 효율적으로 구현할 수 있죠! 🔔📢

RabbitMQ의 고급 기능

RabbitMQ는 기본적인 메시징 기능 외에도 다양한 고급 기능을 제공합니다:

- Exchange 타입: Direct, Fanout, Topic, Headers 등 다양한 라우팅 전략을 지원합니다. 🔀

- 메시지 지속성: 서버 재시작 시에도 메시지를 보존할 수 있습니다. 💾

- 클러스터링: 여러 노드를 하나의 논리적 브로커로 구성할 수 있습니다. 🌐

- 플러그인: 다양한 플러그인을 통해 기능을 확장할 수 있습니다. 🔌

- SSL 지원: 보안 연결을 통해 메시지를 안전하게 전송할 수 있습니다. 🔒

RabbitMQ의 미래

RabbitMQ는 계속해서 발전하고 있으며, 최신 트렌드에 맞춰 다음과 같은 영역에서 개선이 이루어지고 있습니다:

- 클라우드 네이티브 환경 지원 강화

- 스트리밍 지원 개선

- 보안 기능 강화

- 성능 최적화

이러한 발전은 RabbitMQ가 앞으로도 메시징 시스템의 중요한 선택지로 자리매김할 것임을 보여줍니다.

주의사항: RabbitMQ는 강력한 도구이지만, 적절한 설정과 관리가 필요합니다. 메시지 큐가 너무 커지거나, 소비자가 메시지를 처리하지 못하는 상황을 방지하기 위해 모니터링과 적절한 리소스 관리가 중요합니다. 🔍⚠️

자, 이제 RabbitMQ에 대해 꽤 깊이 있게 알아보았습니다. RabbitMQ는 Celery와 함께 사용될 때 그 진가를 더욱 발휘합니다. 다음 섹션에서는 이 두 기술이 어떻게 조화롭게 작동하여 강력한 분산 작업 큐 시스템을 구축하는지 살펴보겠습니다. 준비되셨나요? 우리의 동적 듀오가 펼치는 환상의 콜라보레이션으로 함께 떠나볼까요? Let's go! 🚀🐰

4. Celery와 RabbitMQ의 환상의 콜라보 💑

자, 이제 우리의 주인공들인 Celery와 RabbitMQ가 어떻게 함께 작동하여 강력한 분산 작업 큐 시스템을 만드는지 알아볼 시간입니다! 이 두 기술의 조합은 마치 완벽한 춤을 추는 커플처럼 아름답고 효율적입니다. 💃🕺

Celery + RabbitMQ: Celery는 분산 작업 처리를 담당하고, RabbitMQ는 메시지 브로커로서 작업 메시지를 관리합니다. 이 조합은 확장성, 신뢰성, 유연성을 모두 갖춘 강력한 시스템을 만들어냅니다.

Celery와 RabbitMQ의 협업 과정

두 기술의 협업 과정을 단계별로 살펴보겠습니다:

- 작업 요청: 클라이언트가 Celery에 작업을 요청합니다.

- 메시지 발행: Celery는 작업을 메시지로 변환하여 RabbitMQ에 발행합니다.

- 메시지 소비: Celery Worker가 RabbitMQ로부터 메시지를 가져와 작업을 처리합니다.

- 결과 반환: 작업 처리가 완료되면 결과를 클라이언트에게 반환합니다.

Celery와 RabbitMQ 조합의 장점

확장성 📈

워커를 쉽게 추가하여 처리 능력을 향상시킬 수 있습니다.

신뢰성 🛡️

메시지 지속성과 작업 재시도 기능으로 데이터 손실을 방지합니다.

유연성 🔄

다양한 작업 유형과 우선순위를 지원합니다.

실제 구현 예시

Celery와 RabbitMQ를 함께 사용하는 간단한 예제를 살펴보겠습니다:

# tasks.py

from celery import Celery

app = Celery('tasks', broker='pyamqp://guest@localhost//')

@app.task

def add(x, y):

return x + y

# 사용 예시

from tasks import add

result = add.delay(4, 4)

print(f"Task ID: {result.id}")

print(f"Result: {result.get()}")

이 예제에서 Celery는 RabbitMQ를 브로커로 사용하여 작업을 관리합니다. add 함수는 Celery 작업으로 정의되어 있으며, delay() 메서드를 통해 비동기적으로 실행됩니다.

재능넷 활용 팁: 재능넷(https://www.jaenung.net)에서 이 조합을 활용하면, 예를 들어 대규모 포트폴리오 검색 및 추천 시스템을 구현할 수 있습니다. 사용자의 검색 요청을 Celery 작업으로 처리하고, RabbitMQ를 통해 여러 워커에 분산하여 빠르고 효율적인 검색 결과를 제공할 수 있습니다! 🔍🚀

고급 사용 시나리오

Celery와 RabbitMQ의 조합은 다양한 고급 시나리오에서도 활용될 수 있습니다:

- 주기적 작업 스케줄링: 정기적인 데이터 백업, 리포트 생성 등을 자동화할 수 있습니다. 🔄

- 실시간 데이터 처리: 스트리밍 데이터를 실시간으로 처리하고 분석할 수 있습니다. 📊

- 마이크로서비스 아키텍처: 서비스 간 비동기 통신을 구현하여 느슨한 결합을 달성할 수 있습니다. 🏗️

- 장시간 실행 작업 관리: 대용량 파일 처리, 복잡한 계산 등을 백그라운드에서 처리할 수 있습니다. ⏳

성능 최적화 팁

Celery와 RabbitMQ를 함께 사용할 때 성능을 최적화하기 위한 몇 가지 팁을 소개합니다:

- 적절한 동시성 설정: 워커의 동시성 레벨을 시스템 리소스에 맞게 조정합니다.

- 메시지 압축: 대용량 메시지의 경우 압축을 사용하여 네트워크 대역폭을 절약합니다.

- 결과 백엔드 최적화: 필요한 경우에만 결과를 저장하고, 적절한 만료 시간을 설정합니다.

- 배치 처리: 가능한 경우 작업을 배치로 그룹화하여 처리합니다.

- 모니터링 도구 활용: Flower와 같은 도구를 사용하여 시스템 성능을 지속적으로 모니터링합니다.

주의사항: Celery와 RabbitMQ의 조합은 강력하지만, 적절한 설정과 관리가 필요합니다. 메모리 사용량, 디스크 공간, 네트워크 대역폭 등을 주의 깊게 모니터링하고 관리해야 합니다. 또한, 장애 상황에 대비한 적절한 복구 전략을 수립하는 것도 중요합니다! 🔍⚠️

자, 이제 Celery와 RabbitMQ가 어떻게 환상의 팀워크를 이루는지 자세히 알아보았습니다. 이 강력한 조합은 현대적인 분산 시스템의 핵심 구성 요소로, 복잡한 작업 처리와 메시징 요구사항을 효과적으로 해결할 수 있습니다. 다음 섹션에서는 이 시스템을 실제로 구축하고 설정하는 방법에 대해 더 자세히 알아보겠습니다. 준비되셨나요? 실전으로 뛰어들 시간입니다! 🏊♂️💻

5. 실전! Celery와 RabbitMQ 설정하기 🛠️

자, 이제 이론은 충분히 배웠으니 실제로 Celery와 RabbitMQ를 설정하고 사용해볼 시간입니다! 마치 레고 블록을 조립하듯, 우리의 분산 작업 큐 시스템을 하나씩 만들어 나가 보겠습니다. 🧱🔧

준비물: Python이 설치된 컴퓨터, 약간의 명령줄 사용 경험, 그리고 무엇보다 열정! 🔥 자, 시작해볼까요?

1단계: 환경 설정

먼저, 필요한 소프트웨어를 설치하고 가상 환경을 만들어 봅시다.

# 가상 환경 생성 및 활성화

python -m venv celery_env

source celery_env/bin/activate # Windows의 경우: celery_env\Scripts\activate

# 필요한 패키지 설치

pip install celery

pip install "celery[redis]"

RabbitMQ는 별도로 설치해야 합니다. 공식 웹사이트에서 운영 체제에 맞는 버전을 다운로드하여 설치해주세요.

2단계: Celery 애플리케이션 생성

이제 Celery 애플리케이션을 생성해 봅시다. tasks.py 파일을 만들고 다음 내용을 입력합니다:

# tasks.py

from celery import Celery

app = Celery('tasks', broker='pyamqp://guest@localhost//')

@app.task

def add(x, y):

return x + y

3단계: RabbitMQ 실행

RabbitMQ 서버를 실행합니다. 설치 방법에 따라 명령어가 다를 수 있습니다:

# Linux/macOS

sudo service rabbitmq-server start

# Windows

rabbitmq-server start

4단계: Celery Worker 실행

이제 Celery Worker를 실행하여 작업을 처리할 준비를 합니다:

celery -A tasks worker --loglevel=info

5단계: 작업 실행

새로운 터미널 창을 열고, Python 인터프리터를 실행하여 작업을 제출해 봅시다:

>>> from tasks import add

>>> result = add.delay(4, 4)

>>> result.get()

8

축하합니다! 🎉 방금 여러분은 첫 번째 Celery 작업을 성공적으로 실행했습니다!

고급 설정

기본 설정을 마스터했다면, 이제 좀 더 고급 설정을 살펴볼까요?

1. 결과 백엔드 설정

작업 결과를 저장하기 위해 Redis를 결과 백엔드로 사용할 수 있습니다:

app = Celery('tasks',

broker='pyamqp://guest@localhost//',

backend='redis://localhost')

2. 동시성 설정

Worker의 동시성 레벨을 조정할 수 있습니다:

celery -A tasks worker --concurrency=4 --loglevel=info

3. 작업 라우팅

여러 큐를 사용하여 작업을 라우팅할 수 있습니다:

app.conf.task_routes = {'tasks.add': {'queue': 'arithmetic'}}

4. 주기적 작업 설정

Celery Beat를 사용하여 주기적 작업을 설정할 수 있습니다:

from celery.schedules import crontab

app.conf.beat_schedule = {

'add-every-30-seconds': {

'task': 'tasks.add',

'schedule': 30.0,

'args': (16, 16)

},

}

모니터링 도구 설정

Flower를 사용하여 Celery를 모니터링할 수 있습니다:

pip install flower

celery -A tasks flower

이제 http://localhost:5555에서 Celery 대시보드에 접근할 수 있습니다.

보안 주의사항: 실제 운영 환경에서는 적절한 보안 설정(인증, SSL 등)을 반드시 적용해야 합니다. RabbitMQ와 Redis의 기본 설정은 보안에 취약할 수 있으므로 주의가 필요합니다! 🔒

문제 해결 팁

- 연결 오류: 브로커 URL이 올바른지, RabbitMQ 서버가 실행 중인지 확인하세요.

- 작업이 실행되지 않음: Worker가 실행 중인지, 올바른 큐를 모니터링하고 있는지 확인하세요.

- 결과를 받지 못함: 결과 백엔드 설정을 확인하고,

get()메서드에 타임아웃을 설정해 보세요. - 메모리 사용량 증가: 작업 결과의 만료 시간을 설정하고, 주기적으로 정리 작업을 수행하세요.

재능넷 활용 예시: 재능넷(https://www.jaenung.net)에서 이 설정을 활용하면, 예를 들어 새로운 프로젝트가 등록될 때마다 관련 프리랜서에게 자동으로 알림을 보내는 시스템을 구축할 수 있습니다. Celery 작업으로 알림 발송을 처리하고, RabbitMQ를 통해 작업을 분산하여 대규모 사용자에게도 빠르게 알림을 전달할 수 있죠! 📢🚀

성능 최적화 팁

- 프리펫칭(Prefetching): Worker가 한 번에 가져올 작업의 수를 조절하여 성능을 최적화할 수 있습니다.

app.conf.worker_prefetch_multiplier = 1 - 작업 시간 제한: 장시간 실행되는 작업으로 인한 병목 현상을 방지합니다.

@app.task(time_limit=30) def limited_time_task(): pass - 작업 우선순위: 중요한 작업에 높은 우선순위를 부여합니다.

@app.task(priority=10) def high_priority_task(): pass - 배치 처리: 여러 작은 작업을 하나의 큰 작업으로 묶어 처리합니다.

from celery import group tasks = [add.s(i, i) for i in range(10)] result = group(tasks)().get()

확장성 고려사항

시스템이 성장함에 따라 다음 사항들을 고려해야 합니다:

- Worker 확장: 필요에 따라 Worker를 여러 서버에 분산 배치합니다.

- RabbitMQ 클러스터링: 고가용성과 처리량 향상을 위해 RabbitMQ를 클러스터로 구성합니다.

- 결과 백엔드 스케일링: Redis 클러스터를 사용하여 결과 저장소를 확장합니다.

- 모니터링 강화: Prometheus, Grafana 등을 활용하여 상세한 메트릭을 수집하고 시각화합니다.

마무리

이제 여러분은 Celery와 RabbitMQ를 사용하여 기본적인 분산 작업 큐 시스템을 설정하고 운영할 수 있게 되었습니다! 🎓 이 강력한 도구들을 활용하면, 복잡한 백그라운드 작업 처리, 대규모 데이터 처리, 실시간 알림 시스템 등 다양한 시나리오에 대응할 수 있습니다.

하지만 기억하세요, 실제 운영 환경에서는 보안, 성능, 확장성 등 더 많은 요소들을 고려해야 합니다. 지속적인 학습과 경험을 통해 여러분의 시스템을 더욱 견고하고 효율적으로 만들어 나가세요!

다음 단계: 이제 기본적인 설정을 마스터했으니, 다음 섹션에서는 실제 작업을 정의하고 실행하는 방법에 대해 더 자세히 알아보겠습니다. 복잡한 작업 체인, 에러 처리, 재시도 로직 등 더 고급 주제들을 다룰 예정이니 기대해 주세요! 🚀📚

6. 작업 정의와 실행: 당신의 첫 분산 작업 🎉

자, 이제 Celery와 RabbitMQ의 기본 설정을 마쳤으니, 실제로 작업을 정의하고 실행하는 방법을 알아볼 차례입니다. 이 과정은 마치 요리사가 새로운 레시피를 만들고 실제로 요리를 하는 것과 비슷합니다. 준비되셨나요? 맛있는 코드를 만들어 봅시다! 👨🍳👩🍳

기본 작업 정의하기

먼저, 간단한 작업을 정의해 보겠습니다. tasks.py 파일에 다음 내용을 추가합니다:

from celery import Celery

import time

app = Celery('tasks', broker='pyamqp://guest@localhost//')

@app.task

def long_task(duration):

time.sleep(duration)

return f"Task completed after {duration} seconds"

@app.task(bind=True)

def progress_task(self, duration):

for i in range(duration):

time.sleep(1)

self.update_state(state='PROGRESS', meta={'current': i, 'total': duration})

return "Task completed!"

여기서 우리는 두 가지 작업을 정의했습니다:

long_task: 지정된 시간 동안 대기한 후 결과를 반환합니다.progress_task: 진행 상황을 업데이트하면서 작업을 수행합니다.

작업 실행하기

이제 이 작업들을 실행해 봅시다. Python 인터프리터를 열고 다음 코드를 실행합니다:

>>> from tasks import long_task, progress_task

# 비동기 실행

>>> result = long_task.delay(10)

>>> result.id

'1234-5678-90ab-cdef'

# 결과 확인

>>> result.ready()

False

>>> result.get(timeout=15)

'Task completed after 10 seconds'

# 진행 상황 확인

>>> progress_result = progress_task.delay(5)

>>> progress_result.ready()

False

>>> progress_result.info

{'current': 2, 'total': 5}

>>> progress_result.get(timeout=10)

'Task completed!'

팁: delay() 메서드는 apply_async()의 간편 버전입니다. 더 세밀한 제어가 필요한 경우 apply_async()를 사용할 수 있습니다.

작업 체인 만들기

여러 작업을 연결하여 복잡한 워크플로우를 만들 수 있습니다:

from celery import chain

@app.task

def add(x, y):

return x + y

@app.task

def multiply(x, y):

return x * y

# (2 + 2) * 3

result = chain(add.s(2, 2), multiply.s(3))()

print(result.get()) # 출력: 12

에러 처리와 재시도

작업 실행 중 오류가 발생할 수 있습니다. 이를 처리하고 재시도하는 방법을 알아봅시다:

from celery import Task

from celery.exceptions import MaxRetriesExceededError

class RetryTask(Task):

max_retries = 3

default_retry_delay = 5 # 5초 후 재시도

@app.task(base=RetryTask)

def might_fail(x, y):

try:

if x + y > 10:

raise ValueError("Sum is too large!")

return x + y

except ValueError as exc:

try:

self.retry(exc=exc)

except MaxRetriesExceededError:

return "Failed after multiple attempts"

주기적 작업 설정

정기적으로 실행되어야 하는 작업을 설정할 수 있습니다:

from celery.schedules import crontab

app.conf.beat_schedule = {

'add-every-morning': {

'task': 'tasks.add',

'schedule': crontab(hour=7, minute=30),

'args': (2, 2),

},

}

재능넷 활용 예시: 재능넷(https://www.jaenung.net)에서 이러한 작업 정의와 실행 방식을 활용하면, 예를 들어 매일 밤 인기 있는 프리랜서의 포트폴리오를 분석하고 추천 목록을 업데이트하는 작업을 자동화할 수 있습니다. 또한, 대용량 파일 업로드 시 진행 상황을 실시간으로 사용자에게 보여줄 수 있죠! 🌟📊

작업 모니터링

Flower를 사용하여 작업의 상태를 실시간으로 모니터링할 수 있습니다:

celery -A tasks flower

이제 http://localhost:5555에서 대시보드에 접근할 수 있습니다.

성능 최적화 팁

- 작업 그룹화: 여러 작은 작업을 하나의 큰 작업으로 묶어 오버헤드를 줄입니다.

- 결과 백엔드 최적화: 필요한 경우에만 결과를 저장하고, 적절한 만료 시간을 설정합니다.

- 작업 우선순위 설정: 중요한 작업에 높은 우선순위를 부여합니다.

- 적절한 동시성 레벨 설정: 시스템 리소스에 맞게 Worker의 동시성을 조정합니다.

보안 고려사항

분산 작업 시스템을 구축할 때는 보안에도 주의를 기울여야 합니다:

- 민감한 정보는 환경 변수나 안전한 설정 관리 시스템을 통해 관리합니다.

- 메시지 브로커와 결과 백엔드에 대한 접근을 제한하고 암호화합니다.

- 작업 실행 시 최소 권한 원칙을 적용합니다.

- 입력 데이터를 적절히 검증하여 악의적인 코드 실행을 방지합니다.

주의사항: 실제 운영 환경에서는 더욱 철저한 보안 조치가 필요합니다. 네트워크 분리, 접근 제어, 로깅 및 모니터링 등을 고려해야 합니다. 🔒

마무리

이제 여러분은 Celery를 사용하여 다양한 유형의 분산 작업을 정의하고 실행할 수 있게 되었습니다! 🎉 이러한 기술을 활용하면 복잡한 백그라운드 프로세스, 대규모 데이터 처리, 주기적인 작업 등을 효율적으로 관리할 수 있습니다.

다음 단계로는 더 복잡한 워크플로우 관리, 대규모 시스템에서의 최적화 전략, 그리고 실제 프로덕션 환경에서의 운영 노하우 등을 학습해 보는 것이 좋겠죠. 계속해서 실험하고, 학습하고, 개선해 나가세요!

다음 단계: 이제 기본적인 작업 정의와 실행 방법을 익혔으니, 다음 섹션에서는 더 고급 기능인 작업 스케줄링과 모니터링에 대해 자세히 알아보겠습니다. 대규모 시스템에서 작업을 효율적으로 관리하고 모니터링하는 방법을 배워볼 거예요! 🚀📊

7. 고급 기능: 작업 스케줄링과 모니터링 📊

자, 이제 우리는 Celery와 RabbitMQ를 사용하여 기본적인 작업을 정의하고 실행하는 방법을 배웠습니다. 하지만 실제 프로덕션 환경에서는 더 복잡한 요구사항들이 있죠. 작업을 정기적으로 실행해야 하거나, 시스템의 상태를 실시간으로 모니터링해야 할 수도 있습니다. 이번 섹션에서는 이러한 고급 기능들을 살펴보겠습니다. 준비되셨나요? 더 깊은 물로 뛰어들어 봅시다! 🏊♂️🌊

작업 스케줄링

Celery Beat를 사용하면 주기적으로 실행되어야 하는 작업을 쉽게 스케줄링할 수 있습니다.

from celery import Celery

from celery.schedules import crontab

app = Celery('tasks', broker='pyamqp://guest@localhost//')

app.conf.beat_schedule = {

'add-every-morning': {

'task': 'tasks.add',

'schedule': crontab(hour=7, minute=30),

'args': (2, 2),

},

'add-every-30-seconds': {

'task': 'tasks.add',

'schedule': 30.0,

'args': (16, 16)

},

}

@app.task

def add(x, y):

return x + y

이 설정으로 Celery Beat를 실행하면:

- 매일 아침 7시 30분에

add(2, 2)가 실행됩니다. - 30초마다

add(16, 16)이 실행됩니다.

팁: crontab 표현식을 사용하면 더 복잡한 스케줄도 쉽게 설정할 수 있습니다. 예를 들어, crontab(minute=0, hour='*/3')는 3시간마다 작업을 실행합니다.

작업 모니터링

작업 모니터링은 시스템의 건강 상태를 파악하고 문제를 조기에 발견하는 데 중요합니다. Celery는 다양한 모니터링 도구를 제공합니다.

1. Flower

Flower는 Celery를 위한 실시간 웹 기반 모니터링 도구입니다.

pip install flower

celery -A tasks flower

이제 http://localhost:5555에서 대시보드에 접근할 수 있습니다.

2. Celery 이벤트

Celery의 이벤트 시스템을 사용하여 커스텀 모니터링 솔루션을 구축할 수 있습니다.

from celery import Celery

app = Celery('tasks', broker='pyamqp://guest@localhost//')

@app.task

def add(x, y):

return x + y

@app.on_after_configure.connect

def setup_periodic_tasks(sender, **kwargs):

sender.add_periodic_task(10.0, add.s(2, 2), name='add every 10')

@app.on_after_finalize.connect

def setup_task_monitor(sender, **kwargs):

with sender.connection() as conn:

recv = sender.events.Receiver(conn, handlers={

'task-succeeded': task_succeeded_handler,

'task-failed': task_failed_handler,

})

recv.capture(limit=None, timeout=None)

def task_succeeded_handler(event):

print(f"Task succeeded: {event['uuid']}")

def task_failed_handler(event):

print(f"Task failed: {event['uuid']}")

3. Prometheus + Grafana

대규모 시스템에서는 Prometheus와 Grafana를 사용하여 더 강력한 모니터링 및 알림 시스템을 구축할 수 있습니다.

pip install celery-prometheus-exporter

celery-prometheus-exporter --broker=redis://localhost:6379/0

이후 Prometheus에서 메트릭을 수집하고 Grafana로 시각화할 수 있습니다.

재능넷 활용 예시: 재능넷(https://www.jaenung.net)에서 이러한 고급 스케줄링과 모니터링 기능을 활용하면, 예를 들어 매일 밤 인기 프로젝트 순위를 업데이트하고, 실시간으로 시스템 성능을 모니터링하여 사용자 경험을 최적화할 수 있습니다. 또한, 특정 임계값을 넘어가면 관리자에게 자동으로 알림을 보내는 시스템을 구축할 수 있죠! 🏆📈

성능 최적화 전략

- 작업 우선순위 설정: 중요한 작업에 높은 우선순위를 부여합니다.

@app.task(priority=10) def high_priority_task(): pass - 작업 시간 제한: 장시간 실행되는 작업으로 인한 병목 현상을 방지합니다.

@app.task(time_limit=30) def limited_time_task(): pass - 작업 그룹화: 여러 작은 작업을 하나의 큰 작업으로 묶어 오버헤드를 줄입니다.

from celery import group tasks = [add.s(i, i) for i in range(10)] result = group(tasks)().get() - 결과 백엔드 최적화: 필요한 경우에만 결과를 저장하고, 적절한 만료 시간을 설정합니다.

@app.task(ignore_result=True) def no_result_task(): pass

장애 대응 전략

대규모 시스템에서는 장애 상황에 대비한 전략이 필수적입니다:

- 재시도 메커니즘: 일시적인 오류에 대비해 자동 재시도 로직을 구현합니다.

- 백오프 전략: 연속적인 실패 시 재시도 간격을 점진적으로 늘립니다.

- 서킷 브레이커: 지속적인 오류 발생 시 시스템 보호를 위해 작업 실행을 일시 중단합니다.

- 폴백 메커니즘: 주 시스템 장애 시 대체 시스템으로 전환할 수 있는 로직을 구현합니다.

from celery import Task

from celery.exceptions import MaxRetriesExceededError

class RetryTask(Task):

max_retries = 3

default_retry_delay = 5 # 5초 후 재시도

def on_failure(self, exc, task_id, args, kwargs, einfo):

print(f"Task {task_id} failed: {exc}")

# 여기에 알림 로직 추가

@app.task(base=RetryTask)

def might_fail(x, y):

try:

result = x / y # 0으로 나누면 에러 발생

return result

except ZeroDivisionError as exc:

try:

self.retry(exc=exc, countdown=self.default_retry_delay * self.request.retries)

except MaxRetriesExceededError:

# 폴백 로직 실행

return "Unable to perform division"

주의사항: 모니터링 시스템 자체도 장애가 발생할 수 있습니다. 중요한 시스템의 경우, 여러 모니터링 도구를 병행 사용하고 정기적으로 모니터링 시스템의 건강 상태를 확인하세요. 🔍🚨

마무리

이제 여러분은 Celery와 RabbitMQ를 사용하여 고급 작업 스케줄링을 수행하고, 시스템을 효과적으로 모니터링할 수 있게 되었습니다! 🎉 이러한 기술을 활용하면 대규모 분산 시스템에서도 안정적이고 효율적인 작업 처리가 가능해집니다.

하지만 기억하세요, 모든 시스템은 고유한 특성과 요구사항이 있습니다. 여기서 배운 내용을 기반으로 여러분의 시스템에 가장 적합한 솔루션을 찾아 구현해 보세요. 지속적인 모니터링, 성능 최적화, 그리고 장애 대응 전략 수립을 통해 더욱 견고한 시스템을 만들어 나갈 수 있을 거예요.

다음 단계: 이제 고급 기능들까지 살펴보았으니, 다음 섹션에서는 실제 프로덕션 환경에서 Celery와 RabbitMQ를 운영할 때 고려해야 할 사항들과 최적의 성능을 위한 튜닝 전략에 대해 알아보겠습니다. 대규모 시스템에서의 실전 노하우를 공유할 예정이니 기대해 주세요! 🚀💼

8. 성능 최적화와 스케일링 전략 📈

자, 이제 우리는 Celery와 RabbitMQ를 사용하여 분산 작업 큐 시스템을 구축하고, 고급 기능들을 활용하는 방법까 지 배웠습니다. 하지만 실제 프로덕션 환경, 특히 대규모 시스템에서는 성능 최적화와 스케일링이 매우 중요합니다. 이번 섹션에서는 시스템의 성능을 극대화하고 대규모로 확장하는 전략에 대해 알아보겠습니다. 준비되셨나요? 성능의 세계로 뛰어들어 봅시다! 🚀💨

Worker 최적화

Worker는 Celery 시스템의 핵심 구성 요소입니다. Worker를 최적화하면 전체 시스템의 성능을 크게 향상시킬 수 있습니다.

- 동시성 설정: Worker의 동시성 레벨을 시스템 리소스에 맞게 조정합니다.

celery -A tasks worker --concurrency=4 --loglevel=info - 프리펫칭: Worker가 한 번에 가져올 작업의 수를 조절합니다.

app.conf.worker_prefetch_multiplier = 1 - 작업 시간 제한: 장시간 실행되는 작업으로 인한 병목 현상을 방지합니다.

@app.task(time_limit=30, soft_time_limit=20) def limited_time_task(): pass

메시지 브로커 (RabbitMQ) 최적화

RabbitMQ의 성능은 전체 시스템의 처리량에 큰 영향을 미칩니다.

- 지속성 설정: 필요한 경우에만 메시지 지속성을 사용합니다.

app.conf.task_queue_ha_policy = 'all' - 큐 최적화: 작업 특성에 따라 여러 큐를 사용하여 부하를 분산합니다.

app.conf.task_routes = { 'tasks.high_priority': {'queue': 'high_priority'}, 'tasks.low_priority': {'queue': 'low_priority'}, } - 클러스터링: 고가용성과 처리량 향상을 위해 RabbitMQ를 클러스터로 구성합니다.

결과 백엔드 최적화

결과 저장소의 효율적인 관리는 시스템의 전반적인 성능 향상에 기여합니다.

- 결과 만료 설정: 불필요한 결과를 자동으로 제거합니다.

app.conf.result_expires = 3600 # 1시간 후 만료 - 압축 사용: 대용량 결과의 경우 압축을 사용하여 저장 공간과 네트워크 대역폭을 절약합니다.

app.conf.result_compression = 'gzip' - 결과 무시: 결과가 필요 없는 작업의 경우 결과 저장을 비활성화합니다.

@app.task(ignore_result=True) def no_result_task(): pass

대규모 스케일링 전략

시스템이 성장함에 따라 효과적인 스케일링 전략이 필요합니다.

- 수평적 확장: Worker를 여러 서버에 분산 배치합니다.

# 여러 서버에서 Worker 실행 celery -A tasks worker --loglevel=info - 동적 스케일링: 부하에 따라 Worker 수를 자동으로 조절합니다. 클라우드 환경에서는 auto-scaling 그룹을 활용할 수 있습니다.

- 지역 분산: 글로벌 서비스의 경우, 지역별로 Worker를 배치하여 지연 시간을 최소화합니다.

- 작업 우선순위: 중요한 작업에 높은 우선순위를 부여하여 리소스 경쟁 시 먼저 처리되도록 합니다.

@app.task(priority=10) def high_priority_task(): pass

재능넷 활용 예시: 재능넷(https://www.jaenung.net)에서 이러한 최적화 및 스케일링 전략을 적용하면, 예를 들어 성수기(예: 연말 프로젝트 마감 시즌)에 급증하는 트래픽과 작업량을 효과적으로 처리할 수 있습니다. 동적 스케일링을 통해 필요에 따라 자동으로 리소스를 확장하고, 작업 우선순위 설정으로 중요한 매칭 작업이 지연 없이 처리되도록 할 수 있죠! 🚀🌟

성능 모니터링 및 튜닝

지속적인 성능 모니터링과 튜닝은 시스템 최적화의 핵심입니다.

- 프로파일링: cProfile이나 py-spy 같은 도구를 사용하여 작업의 병목점을 찾습니다.

- 메트릭 수집: Prometheus, StatsD 등을 사용하여 상세한 성능 메트릭을 수집합니다.

- 대시보드 구축: Grafana를 사용하여 실시간 성능 대시보드를 구축합니다.

- 로드 테스팅: Locust 같은 도구로 대규모 부하 테스트를 수행하여 시스템의 한계를 파악합니다.

# Prometheus 메트릭 예시

from prometheus_client import Counter

task_counter = Counter('celery_tasks_total', 'Total number of Celery tasks', ['task_name'])

@app.task

def my_task():

task_counter.labels(task_name='my_task').inc()

# 작업 로직

고급 최적화 기법

더 높은 수준의 성능을 위한 고급 기법들입니다.

- 배치 처리: 여러 작은 작업을 하나의 큰 작업으로 묶어 처리합니다.

from celery import group tasks = [add.s(i, i) for i in range(1000)] result = group(tasks)().get() - 캐싱: 자주 사용되는 데이터나 계산 결과를 캐시하여 반복적인 작업을 최소화합니다.

from functools import lru_cache @lru_cache(maxsize=100) def expensive_calculation(x): # 복잡한 계산 return result - 비동기 I/O: I/O 바운드 작업의 경우 asyncio를 활용하여 동시성을 높입니다.

- 메모리 최적화: 대용량 데이터 처리 시 제너레이터를 활용하여 메모리 사용을 최소화합니다.

주의사항: 성능 최적화는 양날의 검입니다. 과도한 최적화는 코드의 복잡성을 증가시키고 유지보수를 어렵게 만들 수 있습니다. 항상 측정 가능한 성능 향상과 코드의 가독성/유지보수성 사이의 균형을 고려하세요. 🔍⚖️

마무리

축하합니다! 여러분은 이제 Celery와 RabbitMQ를 사용한 분산 작업 큐 시스템의 성능을 최적화하고 대규모로 확장하는 방법을 알게 되었습니다. 🎉 이러한 전략들을 적용하면, 여러분의 시스템은 대규모 트래픽과 복잡한 작업 처리에도 안정적이고 효율적으로 동작할 수 있을 것입니다.

하지만 기억하세요, 성능 최적화는 끝이 없는 여정입니다. 시스템의 요구사항과 환경은 계속 변화하므로, 지속적인 모니터링과 튜닝이 필요합니다. 또한, 특정 최적화 기법이 모든 상황에 적합한 것은 아니므로, 항상 여러분의 특정 use case에 맞는 최적의 솔루션을 찾아야 합니다.

다음 단계: 이제 성능 최적화와 스케일링 전략까지 마스터했으니, 다음 섹션에서는 실제 프로덕션 환경에서 Celery와 RabbitMQ를 운영할 때 마주칠 수 있는 다양한 도전 과제들과 그 해결 방법에 대해 알아보겠습니다. 실전 경험을 바탕으로 한 노하우를 공유할 예정이니 기대해 주세요! 🚀🔧

9. 실제 사례 연구: 분산 시스템의 힘 💪

지금까지 우리는 Celery와 RabbitMQ를 사용한 분산 작업 큐 시스템의 이론과 실제 구현 방법에 대해 깊이 있게 살펴보았습니다. 이제 이 모든 지식을 실제 세계에 적용해 볼 시간입니다! 이 섹션에서는 실제 사례를 통해 분산 시스템이 어떻게 복잡한 문제를 해결하고 비즈니스에 가치를 더하는지 알아보겠습니다. 준비되셨나요? 실전으로 뛰어들어 봅시다! 🏊♂️🌊

사례 1: 대규모 이미지 처리 시스템

상황: 소셜 미디어 플랫폼에서 사용자가 업로드한 수백만 장의 이미지를 다양한 크기로 리사이징하고 필터를 적용해야 합니다.

해결책:

- Celery 작업으로 이미지 처리 함수를 정의합니다.

- 사용자가 이미지를 업로드하면 Celery 작업을 큐에 추가합니다.

- 여러 Worker가 병렬로 이미지 처리 작업을 수행합니다.

- 처리된 이미지는 CDN에 저장하고 결과 URL을 데이터베이스에 기록합니다.

@app.task(bind=True, max_retries=3)

def process_image(self, image_id, filters):

try:

image = Image.open(f"uploads/{image_id}.jpg")

for filter in filters:

image = apply_filter(image, filter)

image.save(f"processed/{image_id}.jpg")

update_database(image_id, "processed")

except Exception as exc:

self.retry(exc=exc, countdown=60) # 1분 후 재시도

# 사용 예

process_image.delay(image_id, ["sepia", "contrast"])

결과: 이 시스템으로 초당 수천 장의 이미지를 처리할 수 있게 되었고, 사용자 경험이 크게 개선되었습니다.

사례 2: 실시간 추천 시스템

상황: 대형 전자상거래 플랫폼에서 사용자의 행동 데이터를 실시간으로 분석하여 개인화된 상품 추천을 제공해야 합니다.

해결책:

- 사용자 행동(클릭, 구매 등)을 Celery 작업으로 캡처합니다.

- 주기적으로 사용자별 추천 모델을 업데이트하는 Celery 작업을 스케줄링합니다.

- 추천 결과를 캐시에 저장하여 빠른 접근을 가능하게 합니다.

- 부하 분산을 위해 여러 큐와 Worker 그룹을 사용합니다.

@app.task

def capture_user_action(user_id, action, item_id):

# 사용자 행동 데이터 저장

pass

@app.task

def update_user_recommendations(user_id):

# 추천 모델 업데이트

recommendations = generate_recommendations(user_id)

cache.set(f"recommendations:{user_id}", recommendations, ex=3600)

# 매시간 모든 활성 사용자의 추천 업데이트

@app.task

def schedule_recommendations():

active_users = get_active_users()

for user in active_users:

update_user_recommendations.delay(user.id)

# Celery Beat 스케줄링

app.conf.beat_schedule = {

'update-recommendations-hourly': {

'task': 'tasks.schedule_recommendations',

'schedule': crontab(minute=0), # 매시간 실행

},

}

결과: 실시간 개인화 추천으로 전환율이 25% 향상되었고, 시스템은 초당 수만 건의 사용자 행동을 처리할 수 있게 되었습니다.

사례 3: 대규모 데이터 처리 파이프라인

상황: 금융 기관에서 매일 수백 GB의 거래 데이터를 처리하고 분석하여 fraud detection, 리스크 분석, 규제 보고서를 생성해야 합니다.

해결책:

- 데이터 수집, 전처리, 분석, 보고서 생성 등 각 단계를 별도의 Celery 작업으로 정의합니다.

- Celery Canvas를 사용하여 복잡한 작업 흐름을 구성합니다.

- 중간 결과를 분산 캐시(예: Redis)에 저장하여 작업 간 데이터 공유를 최적화합니다.

- 에러 발생 시 자동으로 재시도하고 관리자에게 알림을 보냅니다.

from celery import chain, group

@app.task

def collect_data(date):

# 데이터 수집 로직

pass

@app.task

def preprocess_data(data):

# 데이터 전처리 로직

pass

@app.task

def analyze_fraud(data):

# fraud detection 로직

pass

@app.task

def generate_report(results):

# 보고서 생성 로직

pass

@app.task

def notify_completion(report_id):

# 완료 알림 로직

pass

def process_daily_data(date):

workflow = chain(

collect_data.s(date),

preprocess_data.s(),

group(

analyze_fraud.s(),

analyze_risk.s(),

generate_regulatory_report.s()

),

generate_final_report.s(),

notify_completion.s()

)

return workflow()

# 매일 자정에 실행

@app.task

def schedule_daily_processing():

today = datetime.now().date()

process_daily_data.delay(today)

app.conf.beat_schedule = {

'daily-data-processing': {

'task': 'tasks.schedule_daily_processing',

'schedule': crontab(minute=0, hour=0),

},

}

결과: 데이터 처리 시간이 기존 대비 70% 단축되었고, 실시간에 가까운 fraud detection이 가능해졌습니다. 또한, 규제 보고서 생성 프로세스가 완전 자동화되어 인적 오류가 크게 감소했습니다.

재능넷 활용 예시: 재능넷(https://www.jaenung.net)에서 이러한 분산 시스템 기술을 활용하면, 예를 들어 복잡한 프리랜서-프로젝트 매칭 알고리즘을 구현할 수 있습니다. 사용자의 스킬, 경력, 선호도 등 다양한 요소를 고려하여 최적의 매칭을 실시간으로 제안할 수 있죠. 또한, 대량의 포트폴리오 데이터를 분석하여 트렌드를 파악하고, 이를 바탕으로 프리랜서들에게 맞춤형 스킬 향상 제안을 할 수도 있습니다. 이는 플랫폼의 가치를 크게 높이고 사용자 만족도를 향상시킬 것입니다! 🚀🌟

핵심 교훈

- 확장성: 분산 시스템은 데이터와 사용자 수가 증가해도 유연하게 대응할 수 있습니다.

- 성능: 병렬 처리를 통해 대규모 작업을 빠르게 수행할 수 있습니다.

- 안정성: 작업 재시도, 에러 처리 등을 통해 시스템의 안정성을 높일 수 있습니다.

- 유연성: 복잡한 워크플로우를 모듈화하여 관리하기 쉽고 변경에 유연하게 대응할 수 있습니다.

- 실시간 처리: 대규모 데이터도 실시간에 가까운 처리가 가능해집니다.

주의사항: 분산 시스템은 강력하지만, 복잡성도 증가합니다. 적절한 모니터링, 로깅, 그리고 장애 대응 전략이 필수적입니다. 또한, 데이터 일관성과 트랜잭션 관리에 특별한 주의를 기울여야 합니다. 🔍🛠️

마무리

이러한 실제 사례들을 통해 우리는 Celery와 RabbitMQ를 활용한 분산 작업 큐 시스템이 얼마나 강력하고 유연한지 확인할 수 있었습니다. 이 기술들은 단순히 백그라운드 작업을 처리하는 것을 넘어, 기업의 핵심 비즈니스 프로세스를 혁신하고 경쟁력을 높이는 데 중요한 역할을 합니다.

여러분의 프로젝트나 비즈니스에서도 이러한 분산 시스템의 힘을 활용할 기회가 있을 것입니다. 큰 그림을 보고 시스템을 설계하되, 세부적인 구현에도 신경 쓰는 균형 잡힌 접근이 중요합니다. 끊임없는 학습과 실험을 통해 여러분만의 강력한 분산 시스템을 구축해 나가시기 바랍니다!

다음 단계: 이제 실제 사례를 통해 분산 시스템의 힘을 확인했으니, 마지막 섹션에서는 이 기술의 미래와 여러분이 앞으로 나아갈 방향에 대해 이야기해 보겠습니다. 분산 컴퓨팅의 최신 트렌드와 함께, 여러분이 이 분야에서 전문가로 성장하기 위한 로드맵을 제시할 예정입니다. 흥미진진한 미래가 우리를 기다리고 있습니다! 🚀🔮

10. 마무리: 분산의 미래, 당신의 미래 🚀

축하합니다! 여러분은 이제 Celery와 RabbitMQ를 활용한 분산 작업 큐 시스템의 세계를 깊이 있게 탐험했습니다. 기본 개념부터 고급 최적화 기법, 그리고 실제 사례 연구까지, 우리는 긴 여정을 함께 했습니다. 이제 마지막으로, 이 기술의 미래와 여러분의 앞으로의 여정에 대해 이야기해 보겠습니다. 준비되셨나요? 미래로의 시간 여행을 떠나봅시다! 🕰️✨

분산 시스템의 미래 트렌드

- 서버리스 아키텍처: AWS Lambda, Google Cloud Functions 등과의 통합으로 더욱 유연한 확장성 제공

- 엣지 컴퓨팅: 데이터 처리를 사용자와 더 가까운 곳으로 이동시켜 지연 시간 최소화

- AI/ML 통합: 작업 스케줄링과 리소스 할당에 머신러닝 알고리즘 적용

- 블록체인 기술: 분산 작업의 투명성과 신뢰성 향상을 위한 블록체인 통합

- 실시간 스트리밍: Apache Kafka 등과의 통합으로 실시간 데이터 처리 능력 강화

미래의 재능넷: 이러한 트렌드를 재능넷(https://www.jaenung.net)에 적용하면, 예를 들어 AI 기반의 초개인화된 프로젝트 추천 시스템, 블록체인을 활용한 투명한 계약 및 결제 시스템, 엣지 컴퓨팅을 통한 전 세계 어디서나 빠른 포트폴리오 렌더링 등이 가능해질 것입니다. 이는 플랫폼의 가치를 크게 높이고, 글로벌 인재 시장을 선도하는 데 큰 역할을 할 것입니다! 🌍🚀

당신의 성장 로드맵

분산 시스템 전문가로 성장하기 위한 단계별 가이드:

- 기초 다지기:

- Python, Go, Rust 등 관련 언어 마스터

- 네트워크 프로그래밍과 동시성 프로그래밍 개념 학습

- 데이터베이스 (SQL, NoSQL) 깊이 있게 이해

- 분산 시스템 이론 학습:

- CAP 정리, 일관성 모델, 분산 합의 알고리즘 등 핵심 이론 학습

- "Designing Data-Intensive Applications" by Martin Kleppmann 같은 서적 탐독

- MIT, Stanford 등의 분산 시스템 관련 온라인 강의 수강

- 실전 경험 쌓기:

- 오픈 소스 프로젝트 참여 (예: Celery, RabbitMQ 등)

- 개인 프로젝트를 통해 분산 시스템 구축 경험 축적

- 다양한 규모의 시스템을 설계하고 구현해보기

- 최신 기술 트렌드 따라가기:

- Kubernetes, Docker 등 컨테이너 기술 마스터

- 서버리스 아키텍처, 마이크로서비스 아키텍처 학습

- Apache Kafka, Apache Flink 등 실시간 처리 기술 탐구

- 소프트 스킬 개발:

- 시스템 설계 능력 향상 (아키텍처 패턴, 디자인 패턴 등)

- 팀 협업 및 커뮤니케이션 스킬 강화

- 프로젝트 관리 및 리더십 능력 개발

실천 전략

- 지속적 학습: 매주 최소 2-3시간을 새로운 기술 학습에 투자하세요.

- 프로젝트 기반 학습: 배운 내용을 실제 프로젝트에 적용해 보세요.

- 커뮤니티 참여: 관련 컨퍼런스 참석, 기술 블로그 운영, Stack Overflow 활동 등을 통해 지식을 공유하고 네트워크를 확장하세요.

- 멘토링: 경험 많은 개발자의 조언을 구하거나, 다른 이들을 멘토링하며 자신의 지식을 공고히 하세요.

- 실험 정신: 새로운 기술과 아이디어를 두려워하지 말고 적극적으로 시도해 보세요.

성장 팁: 재능넷(https://www.jaenung.net)과 같은 플랫폼을 활용하여 실제 프로젝트에 참여하거나, 자신의 기술을 공유하는 것도 좋은 방법입니다. 실제 비즈니스 문제를 해결하면서 동시에 자신의 포트폴리오를 구축할 수 있습니다. 또한, 다양한 분야의 전문가들과 협업하며 시야를 넓힐 수 있죠! 🌱🚀

미래를 위한 준비

분산 시스템 기술은 계속해서 진화하고 있습니다. 미래에 대비하기 위해 다음 영역에 주목해 보세요:

- 양자 컴퓨팅: 미래의 분산 시스템에 혁명을 가져올 수 있는 기술

- 5G/6G 네트워크: 초저지연, 초연결 시대의 분산 시스템 설계

- AI 주도 시스템: 자가 최적화, 자가 치유 능력을 갖춘 지능형 분산 시스템

- 지속 가능한 컴퓨팅: 에너지 효율적인 분산 시스템 설계

- 보안과 프라이버시: 점점 더 중요해지는 데이터 보호와 개인정보 보호

마무리 메시지

여러분은 이제 Celery와 RabbitMQ를 활용한 분산 작업 큐 시스템의 세계를 깊이 있게 탐험했습니다. 이는 단순히 기술을 배우는 것을 넘어, 복잡한 문제를 해결하고 대규모 시스템을 설계하는 새로운 사고방식을 익힌 것입니다.

분산 시스템의 세계는 끊임없이 변화하고 발전합니다. 오늘 배운 내용은 여러분의 여정의 시작일 뿐입니다. 계속해서 학습하고, 실험하고, 도전하세요. 여러분이 만들 혁신적인 시스템이 세상을 더 나은 곳으로 만들 수 있습니다.

기억하세요, 모든 위대한 시스템은 작은 아이디어에서 시작됩니다. 여러분의 아이디어가 다음 세대의 기술을 이끌어갈 수 있습니다. 두려워하지 말고 꿈꾸세요, 그리고 그 꿈을 코드로 만들어가세요.

분산 시스템의 미래는 여러분의 손에 달려있습니다. 이제 여러분의 여정을 시작하세요. 미래가 여러분을 기다리고 있습니다!

마지막 조언: 기술은 빠르게 변화하지만, 문제 해결 능력, 지속적 학습 능력, 그리고 협업 능력은 언제나 가치 있습니다. 이러한 핵심 역량을 키우는 데 집중하세요. 그리고 가장 중요한 것은, 여러분이 하는 일을 즐기는 것입니다. 열정이 있다면, 어떤 어려움도 극복할 수 있습니다! 🌟💪

자, 이제 여러분의 멋진 여정이 시작됩니다. 분산 시스템의 세계에서 여러분이 이루게 될 놀라운 성과들을 기대하겠습니다. 항상 호기심을 잃지 말고, 끊임없이 도전하세요. 여러분의 미래는 밝습니다!

행운을 빕니다, 그리고 즐거운 코딩하세요! 🚀🌠